дэна бойд. Разорванная правда (2019)

Автор перевода — Николай Родосский

Редактор — Мария Левунова

Текст был написан как основа для выступления на «Найт Медиа Форум» в Майами 23 февраля 2019 года

Доброе утро! Давайте начнем с небольшой разминки. Пора проверить, как чувствует себя аудитория. Кто из вас ежедневно следит за новостями? (Все поднимают руки.) [1] Кто из вас каждый день сморит Ютуб? (Несколько десятков поднятых рук.) А кто по Ютубу следит за новостями? (Несколько поднятых рук.) Кто не поднял руку — заявляю вам с трибуны: ну вы и старики. (Смех.)

Ютуб

Если серьезно, я хочу начать свое выступление с Ютуба

Если вы поговорите с

Возьмем Пьюдипая. Кто из вас следит за ним постоянно? Вы вообще знаете, кто это такой? (Только мои друзья поднимают руки.) То, что вы его не знаете, это повод для беспокойства. У его канала больше всего подписчиков в мире, он один из важнейших инфлюэнсеров в цифровом пространстве, зарабатывающий миллионы долларов в год. Он формирует культурный ландшафт и определяет то, как общество воспринимает новостную повестку. Пьюдипай — это ник Феликса Чельберга, шведского геймера, который начинал с размещения на Ютубе игровых роликов. С 2013 года у него больше подписчиков, чем у кого бы то ни было (хотя прямо сейчас он борется за лидерство с болливудским аккаунтом [3]). Сейчас у него более 87 миллионов подписчиков. Известность он приобрел, высказываясь на общественные темы. В прошлом году он запустил пародию на CNN под названием PewNews — как он его называет, «самый уважаемый и заслуживающий доверия новостной источник всех времен». Каждый его ролик смотрят миллионы, под каждым — тысячи комментариев. Для многих молодых людей (особенно для белых юношей) Пьюдипай стал героем. Его стиль грубоват, и он часто попадает в истории

Задумайтесь. Самый популярный ютубер — геймер, высказывающийся по общественным вопросам на платформе, которую люди до 25 лет воспринимают как основной источник информации, — считает нормальным каждый день высказывать мысли, которые находят широкую поддержку у расистов.

(Читатели должны знать, что эти слова были произнесены до террористической атаки, совершенной в Крайстчерч, в Новой Зеландии. Перед тем как открыть огонь по невинным людям, террорист, который вел с места событий прямую трансляцию, призвал всех «подписываться на Пьюдипая». СМИ, как обычно, увидели в этом призыве знак того, что террорист одобряет деятельностью ютубера, в то время как на самом деле он, как кажется, троллил Пьюдипая. Чельберг, охваченный скорбью и ужасом, открыто осудил действия террориста, открещиваясь от его ценностей и от посыла теракта.) [4]

Большинство людей не знает, какую огромную роль играет Ютуб как поисковик и новостной сервис. Они думают, что на Ютубе только музыкальные клипы и подборки смешных реклам Супербоула. Но я хочу еще раз обратить ваше внимание: это и поисковик, и рекомендательный сервис, и социальная сеть. Тут есть форумы для обсуждений, свои кумиры и функция автовоспроизведения, предлагающая людям один ролик за другим, удерживая их у экранов часами. Есть в этой системе и серьезные уязвимости, которыми нетрудно воспользоваться для своих целей. И для понимания сегодняшней ситуации очень важно понимать, как это работает.

Я начну с одного яркого примера такого дурного использования, который характерен для всех видов поисковых сред, в том числе для Ютуба. Речь об «информационных прорехах».

Слабые места поисковиков: информационные прорехи

«Информационные прорехи» (data voids) — термин, предложенный Майклом Голебевски из Бинга для описания ситуации, когда у поисковика нет высококачественной информации, которую он мог бы предложить в ответ на конкретный запрос. Что происходит, когда вы что-то ищете, а поисковик не знает, что с этим делать? Одно дело гуглить «баскетбол итоги матча», другое дело — что-то известное лишь узкому кругу лиц, некий уникальный набор слов с минимальным содержанием. И вот на этом слабом месте кто-то может сыграть. И зная, как это работает, вы научитесь видеть уязвимости нашей информационной архитектуре. Мы с Майклом выделили и изучили четыре типа «прорех». Давайте по ним пройдемся.

1. Срочные новости

5 ноября 2017 года новостные издания закидали своих подписчиков уведомлениями. Кто-то из вас был разбужен этими уведомлениями в то воскресенье, кто-то увидел их в течение дня. Так мы узнали о стрельбе в церкви в

В таких ситуациях, когда объем данных ограничен, а запросов внезапно становится очень много, Гугл в срочном порядке обращается к другим источникам, чтобы было что предложить пользователям. Он тащит данные из Твиттера и Реддита, пытаясь выдать самую свежую информацию. Ютуб поступает иначе. Вместо того чтобы обращаться к сторонним сайтам, он ждет, пока пользователи сами загрузят относящийся к делу контент на платформу. И в этот момент различные группы интересов, загружая тексты и видео, пытаются оседлать новостную волну, чтобы оказать влияние на информационный ландшафт. Итак, пока журналисты силились разобраться в происходящем, праворадикалы, включая самопровозглашенных белых националистов, координировались в сети, чтобы, манипулируя Твиттером, Реддитом и Ютубом, донести идею о том, что напавший на церковь в

Один журналист, столкнувший с деятельностью этих групп, оперативно написал очень достойную статью об этом для Newsweek. Он подробно и вдумчиво описал активность праворадикалов, которые все это подстроили. Заголовок, правда, получился из рук вон: «Антифа стоит за убийствами в

Не только Гугл подвергался манипуляциям. На Ютуб сразу же стали заливать ролики люди, пытавшиеся создать (и создававшие) новые ассоциативные связи. Таким образом они хотели повлиять на то, как преподносятся срочные новости, в каком ключе о них говорят. И по сравнению с Гуглом, Ютубу требуется куда больше времени, чтобы навести порядок. Отчасти проблема в том, что там не налажена оперативная подача новостей. Конечно, рано или поздно ABC, NBC, CBS, CNN — все они загружают свои ролики на платформу. Но они не подстраивают свой материал под формат Ютуба. Им не интересны тонкости работы с метаданными, они не вникают в систему рекомендаций и релевантных видео, не пытаются технически связать разные ролики и использовать ключевые слова. А если метаданными не заниматься, если не выстраивать систему ссылок внутри Ютуба, то даже высококачественные ролики будут болтаться внизу страницы. Это первая информационная прореха.

2. Стратегическое использование ключевых слов

В начале 1990-х политик Фрэнк Лунц прославился своими крылатыми фразами. Он мастерски умел найти слова, способные повлиять на формирование общественного мнения. Каждую неделю он проводил совещания с республиканцами на Капитолийском холме [7], где всякий раз выдавал им новую фразочку, которую они должны были всеми силами протащить в медиа. Задачей было обрушить на аудиторию ливень из крылатых выражений, и это принесло плоды. Многие из нас помнят изобретения Лунца — «изменение климата» вместо «глобального потепления», «налог на смерть» вместо «налога на наследство».

Используя эти формулировки на заседаниях, конгрессмены вынуждали новостные медиа расставлять акценты так, как им было выгодно. Эти формулировки закреплялись в сознании, привязывались к обозначаемому явлению, а когда фраза закрепляется в сознании, изменяется картина мира. Можно как угодно относиться к конкретным высказываниям Лунца, но сомневаться в их эффективности не приходится.

Сегодня, в эпоху интернета, многие люди продолжают экспериментировать, придумывая новые и оттачивая старые формулировки на бесчисленных виртуальных площадках, на которые вы, полагаю, не считаете нужным обращать внимание. Они смотрят, какая фразочка «зайдет» аудитории, и затем продвигают успешные находки в информационных экосистемах. При этом они не просто отслеживают реакцию на такие фразочки, но создают тонны контента с их использованием. Они снимают ролики для Ютуба, разбрасывают эти словечки по Википедии, обсуждают их в Твиттере. Они вставляют их к месту и не к месту, пытаясь повлиять на всю экосистему. И уже потом они надеются, что журналисты клюнут и тоже подхватят новое словцо. Таким образом экстремисты транслируют свои теории заговора в мейнстримные медиа.

Для примера возьмем определение «подставная жертва» (crisis actor). Оно возникло на экстремистских онлайн-форумах после стрельбы в начальной школе «Сэнди-Хук» [8] и должно было подорвать доверие к свидетелям, которые рассказывали о массовом убийстве по телевизору. Конспирологи и праворадикалы хотели донести мысль о том, что стрельбы на самом деле не было, а так называемые «подставные жертвы», показанные на экране, были актерами, нанятыми «глубинным государством» [9] с целью надавить на сторонников свободного ношения оружия. Это классическая теория заговора. На Ютуб было залито огромное число роликов, использующих определение «подставная жертва» и продвигающих экстремистскую логику задолго до стрельбы в Паркленде [10]. И когда журналист Андерсон Купер в эфире национального телевидения спросил одного из выживших, Дэвида Хогга, о том, не был ли он «подставной жертвой», люди стали вбивать эту фразу в поисковики. А в этом и был весь смысл! Людей, которые полезли в Ютуб, чтобы разобраться с этим термином, обдало потоком конспирологических роликов.

Наверно, вы не раз слышали и другие словечки из праворадикального и конспирологического жаргона, которые перекочевали в мейнстримные медиа, — «инцелы» [11], «караваны» [12], «глобалисты», «глубинное государство», «геноцид белых» [13]. Употребляя эти слова, журналисты льют воду на мельницу праворадикалов. Цель манипуляторов не в том, чтобы через журналистов воздействовать на аудиторию. Важнее использовать журналистов для изменения информационного ландшафта Гугла и социальных медиа. Чем активнее журналисты употребляют те или иные слова, тем чаще пользователи вбивают их в поисковики. А поисковики приводят их на сайты, переполненные экстремистским и расистским контентом. И вот мы уже скользим вниз по кроличьей норе.

3. Слова, которые мы оставили позади

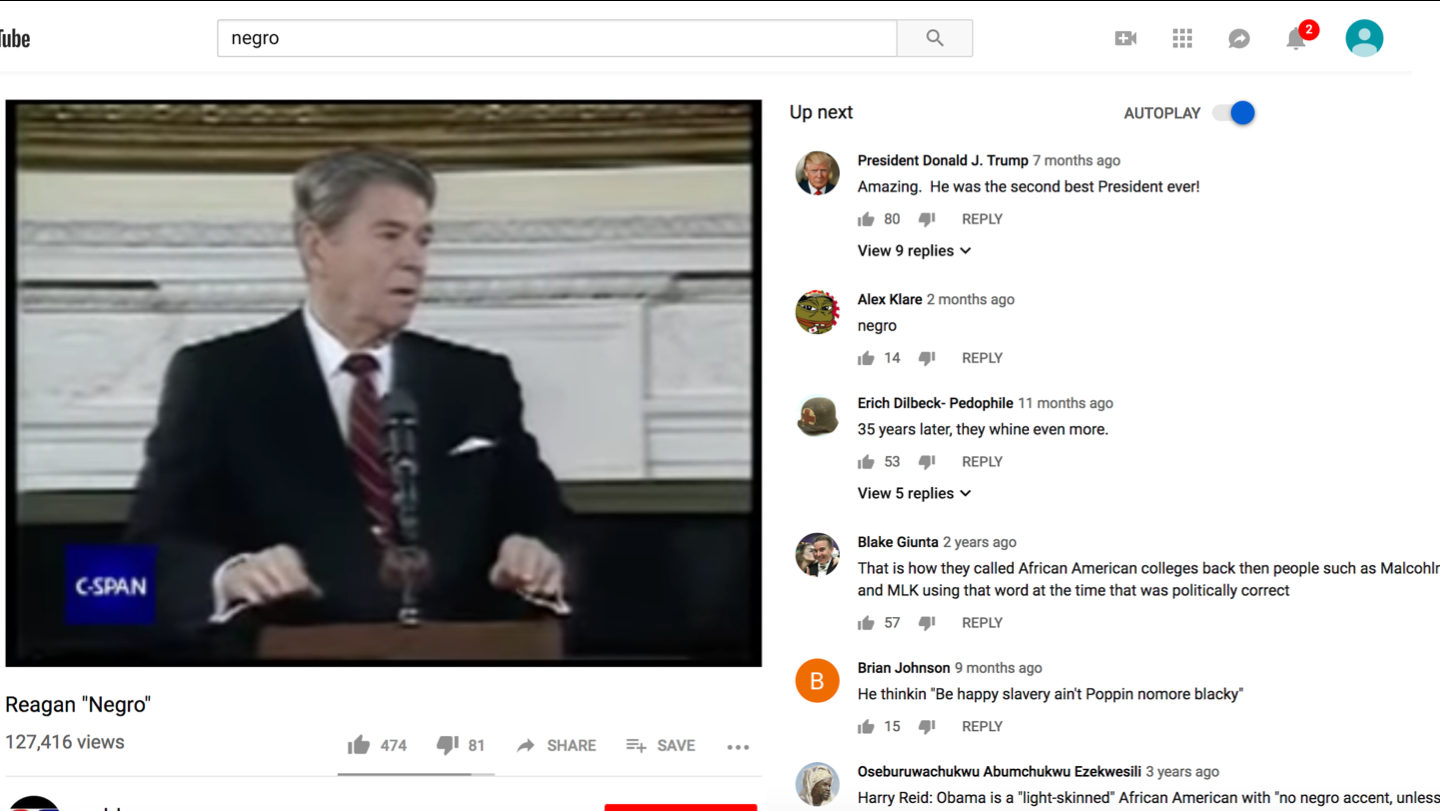

Третий тип информационных прорех связан со словами, когда-то бывшими в употреблении, но вышедшими из него, в особенности с теми, которые сегодня считаются некорректными. Чтобы быть конкретнее, сейчас я употреблю слово, которое некоторых может оскорбить: «негр» (negro). Как и слово «н*ггер» (N-word), оно часто носит уничижительный и ненавистнический характер. Однако, в отличие от него, слово «негр» не имеет внутригруппового хождения.

(После доклада одна женщина рассказала мне, что слово «негр», хотя и может служить оскорблением, в ее афроамериканском сообществе имеет преимущественно положительную окраску. По ее словам, оно все еще употребляется в определенных кругах и литературе. Я принимаю ее точку зрения, хотя ее представления вряд ли согласуются с тем, что можно найти в сети по этому запросу.)

С этим словом почти не создается нового контента. Если загуглить слово «негр», в ответ вам тут же скажут, что слово устарело и является оскорбительным. Вы получите ссылки на исторические труды, словари (включая Urban Dictionary, который предложит вам еще больше оскорбительной информации) и статьи, посвященные контекстуализации этого слова и тому, как его используют расисты.

Но что нам предложит Ютуб? Если набрать «н*ггер», вам покажут ролики об истории расистского использования этого слова. Но если набрать «негр», вы увидите в основном архивные видеозаписи, в том числе с участием известных политиков. Это контент, вырванный из контекста.

Вот запись выступления Рейгана, в котором он произносит слово «негр». Что будет, если я на него кликну? Я получу лишенный контекста и критического анализа ролик, где наш бывший президент отпускает расистское замечание. А кроме того — тьму расистских высказываний в комментариях. Вместо того чтобы поставить вопрос о расистском происхождении этого слова и заставить задуматься о его контексте, Ютуб становится местом, в котором вы наблюдаете расистские замечания как нечто обыденное. Любознательные юноши и девушки, интересующиеся историей тех слов, которые мы оставили позади, натолкнутся на эту информационную прореху, скорее вдыхающую новую жизнь в историю ненависти, чем проблематизирующую ее.

4. Сомнительные запросы

Путь к четвертому типу информационных прорех лежит через сомнительный запрос. Кто будет писать в строке поиска «Был ли Холокост?» Нечего и говорить, что на Ютубе по такому запросу найдешь не слишком много образовательных видео. Мало кто проводит время, записывая ролики, предназначенные развенчать связанную с этим теорию заговора. Поэтому в первую очередь сервис выдает ролики отрицателей Холокоста. Под ними Ютуб, конечно, вставляет ссылку на Википедию, где сможете самостоятельно разобраться в этом вопросе. Но ролики, в которых отрицается Холокост, это даже не самое интересное. Под каждым из них тысячи комментариев. И очень скоро вы увидите комментарий со ссылкой на видео, которое «обязательно надо посмотреть», чтобы «узнать правду о Гитлере». А в этом видео, сделанном с закосом под документальный фильм, вам расскажут, что Холокост — это выдумка. Для многих конспирологов этот ролик — «красная таблетка», которая «откроет людям глаза». Их цель — показать вам его. И ссылками на этот ролик замусорены комментарии под всеми видео по теме Холокоста.

Эти четыре типа прорех являются слабыми местами всякого поисковика. Поисковик не сможет найти высококачественный контент, если его не существует. При этом текстовые поисковики, такие как Гугл или Бинг, гораздо быстрее очищаются от всякой чуши благодаря работе новостников. В экосистеме, основанной на обмене видео, делать это куда сложнее. В Ютубе слишком мало профессионального контента. Официальные новостные каналы пока не умеют работать с этой платформой достаточно оперативно и эффективно. В то же время манипуляторы научились использовать в своих целях не только информационные прорехи, но и работу профессиональных журналистов.

Чем плохи рекомендации

Как я уже говорила, Ютуб это не только поисковик, но и рекомендательный сервис. Открыв ролик на Ютубе, вы тут же увидите подборку «похожих» видео, которые вам предлагают посмотреть. Что еще важнее — когда вы досмотрели ролик до конца, одно из рекомендованных видео включается автоматически. Это очень удобно, если вы слушаете музыку, — вам открывается целый мир новых и подходящих вам музыкальных треков. Но что если вы слушаете политических аналитиков или новости?

Задача рекомендаций и автовоспроизведения в том, чтобы заставить вас подольше задержаться у экрана. Алгоритмы, отвечающие за эти функции, все время «учатся», чтобы выполнять их эффективнее. Разработчики не смотрят на контент, им важно понять, что делает ролик подходящим тому или иному зрителю. Скажем, если кто-то смотрит ролик A, а следом за ним — ролик B (а еще лучше, лайкает и комментирует оба видео), то следующему посмотревшему ролик A будут рекомендовать ролик B. Вроде ничего сложного. Но, конечно, и на этих отношениях можно сыграть. К сожалению, выстраивание таких рекомендательных связей никогда не входило в задачи новостников. Их дело — залить видео и ждать просмотров.

Представьте, что вы ищете на Ютубе информацию о прививках. Почти наверняка сначала вам попадется основанный на фактах высококлассный видеоконтент. Многие организации здравоохранения, включая Центр по контролю и профилактике заболеваний США, со всей ответственностью подходят к созданию роликов, которые доступны в том числе на Ютубе и в которых растолковывается безопасность и важность прививок, а также нелепость антипрививочных теорий. Ролики, признаемся, немного суховаты, но они содержательны и качественно сделаны. Однако антипрививочники из кожи вон лезут, чтобы протолкнуть свои идеи не до конца уверенным в пользе вакцинации родителям, которые ищут сведения о ней в интернете. И многим поисковикам приходится бороться с противниками вакцинации, чьи техники продвижения контента оказались весьма эффективны.

У Ютуба другая проблема. После просмотра ролика, сделанного организацией здравоохранения, каждое третье видео, которое вам предложат, почти наверняка будет конспирологическим. Почему? Потому что сторонники теорий заговоров знают, как налаживать рекомендательные связи. Они знают о важности комментариев, поэтому комментируют видео, которые надо связать. Они знают о важности просмотров, поэтому смотрят оба ролика. Они намеренно дрессируют алгоритмы так, чтобы те связывали контент Центра по контролю заболеваний с контентом антипрививочников. Это значит, что, если вы будете искать на Ютубе видео о вакцинации, вам, скорее всего, предложат в том числе и конспирологические ролики.

Моя коллега Бекки Льюис в своем докладе описала другой способ влияния альтернативщиков на повестку [14]. Центр по контролю заболеваний никогда не пригласит на дискуссию антипрививочника. Однако в политических кругах считается нормальным устраивать дебаты, попутно внушая таким образом ложное чувство равенства оппонентов. Такие неравные дебаты транслируются и в традиционных медиа, и на Ютубе. Но залитая на Ютуб запись будет вести себя иначе, чем на телевидении. Ютуб-каналы мейнстримных медиа публикуют дебаты с альтернативщиками, которые на своих каналах распространяют экстремистские взгляды. Ютуб видит это и получает сигнал связать их в своей системе рекомендаций. Таким образом, тому, кто смотрит на Ютубе мейнстримные каналы, сервис, скорее всего, порекомендует и видео человека с маргинальной точкой зрения. Это результат создания связей и манипулирования алгоритмами. Вы заходите на Ютуб за взвешенной информацией, но уже через пару кликов вам предлагают контент, созданный отщепенцами, экстремистами, конспирологами.

Когда люди узнают об этой проблеме, их первая мысль — что ж, удалите экстремистский контент. И я их понимаю. Они не хотят, чтобы Ютуб помогал распространять антипрививочные, человеконенавистнические или конспирологические взгляды. Я хорошо понимаю этих людей, но в долгосрочной перспективе это не решит проблему. Ютуб уже удалил или понизил рейтинг выдачи колоссального количества материалов, и все равно осталось столько, что просто оторопь берет. Отчасти так происходит потому, что создатели роликов, касающихся повестки (например, антипрививочники), научились обходить запреты. В основном их видео не призывают людей отказаться от вакцинации: они призывают поразмышлять о том, безопасны ли прививки. В этом и суть: посеять сомнения. А удалять контент, задающий вопросы, — правильно ли это? Ютуб в этом отношении особенно щепетилен. Он не хочет прослыть политически ангажированным ресурсом, который удаляет ролики, призывающие к диалогу.

Разумеется, некоторые манипуляторы знают, как воспользоваться чувствительностью компании к вопросам цензуры, на что нужно надавить, чтобы продвинуть свои антинаучные теории. Скажите, многие ли из вас смотрят видео с канала PragerU? Кто из вас слышал о нем?

Этим каналом руководит Деннис Прэйгер, журналист консервативного толка. Канал выпускает по одному видео в неделю. Его цель — развенчать «левацкую риторику», которой, с точки зрения создателей, потчуют студентов в университетах. Их видео популярны на Ютубе, но особенно — в Фейсбуке. Исполнительный директор канала заявляет, что каждый третий американец, зарегистрированный в Фейсбуке, смотрит ролики PragerU. Это впечатляет. Как рассказывают университетские преподаватели, с ними регулярно дискутируют студенты, насмотревшиеся PragerU.

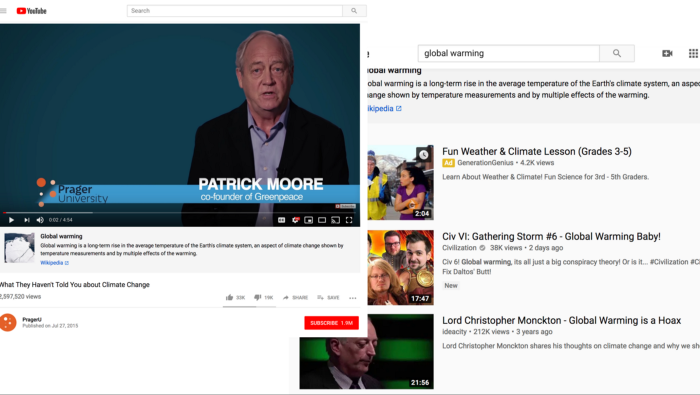

Пользуясь информационными прорехами Ютуба, канал PragerU призывает людей сомневаться в общепринятых ценностях. Он не распространяет ненависть, он просто заставляет людей усомниться в том, во что верит большинство. Например, если вы подросток и вы совсем недавно услышали словосочетание «социальная справедливость» (social justice), вы можете поискать его значение на Ютубе. Там вы найдете не ролики с обсуждением истории этого понятия, его интерпретациями разными общественными движениями или того, почему важно изживать исторически сложившееся неравенство. Вы найдете ролик с канала PragerU, в котором вам расскажут, что «социальная справедливость» — это пропагандистский лозунг, цель которого в том, чтобы запутать и навредить вам [15]. (Конечно, «вы», к которому обращается канал, это вполне определенная аудитория — обычно религиозная и консервативно настроенная. Сознательно или нет, канал подталкивает белых юношей к мысли, что они и есть «настоящие» жертвы угнетения.) Стратегия Прэйгера работает, ведь «социальная справедливость» — еще одно оставленное позади слово: движения за расовое равноправие больше не пользуются им, и поэтому нового контента с ним не появляется.

Однажды посмотрев видео с канала PragerU, в рекомендациях вам будут еще долго попадаться их ролики. А их сотни. Возможно, вам предложат видео «Почему никто не верит мейнстримным медиа» или «Что вам не рассказали про изменение климата». Давайте посмотрим, что там во втором.

Ютуб распознает ролик как спорный, поэтому сопровождает его ссылкой на статью в Википедии. Но почему дается ссылка на статью «Глобальное потепление», а не на «Изменение климата»? Вот уж не знаю. «Глобальное потепление» — еще один оставленный позади термин. Так что, если вы будете искать на Ютубе «глобальное потепление» (что в

Проблема в том, что контент, который продвигает большинство конспирологов, нельзя назвать откровенной ложью. Они лишь предлагают аргументы в пользу пересмотра определенных устоявшихся мнений. Они призывают сомневаться, задавать вопросы. Искать новую информацию, думать своим умом. А если Ютуб удаляет такой контент, даже самый что ни на есть конспирологический, ему бросают обвинения в цензуре. Эта стратегия не нова: такое уже было с Russia Today (RT) и их кампанией «Задавайте вопросы» (Question More), проводившейся в Соединенном Королевстве.

По всей Великобритании RT развесили постеры, гласящие: «Изменение климата: наука или научная фантастика?» Может показаться, что они призывают задавать вопросы, смотреть на проблему с разных точек зрения. А когда правительство распорядилось снять постеры, RT разместили новые: «Вот что бывает! Цензура!» Они разыграли карту свободы слова. Когда их попытку посеять сомнения объявили пропагандой и заставили убрать постеры, они осудили действия властей как покушение на их права.

Я не думаю, что удаление конспирологического или спорного контента приведет в итоге к

Давайте посмотрим на это с другой стороны. Лично я без ума от одной фишки, которую предлагает Спотифай. Не знаю, многие ли из вас пользуются Спотифаем, но наверняка вам знакомо то самое чувство, когда вы слушаете музыку и уже поймали волну и вдруг какая-то совсем не та песня все рушит. Есть музыка, известная своей способностью ломать настроение, например рождественские песни. Не важно, нравится вам Мэрайя Кэри или нет, но если вы кайфуете под We Belong Together, то All I Want for Christmas is You в рекомендациях явно будет не к месту. Вы точно не хотите, чтобы в плейлисте «40 лучших хитов» попалось что-то из ее рождественского альбома. Если вы слушаете рождественскую музыку, значит, у вас уже рождественское настроение, то есть вам ничего кроме рождественской музыки и не нужно. Это такой отдельный мир. То же самое с музыкой для детей. Вам может нравиться группа They Might Be Giants, но это не значит, что вы хотите слушать их детский альбом. Поэтому Спотифай активно вмешивается в работу своих алгоритмов, регулярно пересматривая устоявшиеся связи и выстраивая рекомендации на основе большого количества критериев. А для этого нужно как понимать контент, так и по-настоящему понимать контекст. С Ютубом все сложнее, но я убеждена, что компания должна начать активно изучать и рвать некоторые рекомендательные связи, вычисляя злонамеренное распространение спорного и конспирологического образа мысли на своей платформе. Она должна осознать фундаментальное значение рекомендательного сервиса и свою роль в распространении заблуждений.

Как читать поисковики

Конечно, уже тот факт, что алгоритмы продвигают контент и определяют, что попадет в поле зрения людей, ставит перед нами вопрос: кто решает, что следует продвигать, а что не следует? Как отличить теорию заговора от допустимого сомнения? Где кончается свобода не соглашаться, и от каких мнений следует оберегать? Как социолог, я обязана считать, что неэтично предлагать материалы, ставящие под сомнение изменение климата, тем, кто заинтересовался климатологией. То же самое с материалами, отрицающими Холокост и пользу прививок. Мысль о том, что всякая точка зрения представляет собой одну из равноценных сторон дискуссии, видится мне безответственной и опасной.

Но не все так однозначно. Как исследовательница, я также признаю, что каждый человек является носителем своей правды, которая часто вступает в противоречие с правдами других. Что для одного религия, то для другого миф, а одно политическое воззрение от другого отделяет тончайшая нюансировка. Я также уверена, что у каждого есть своя эпистемологическая установка. Иными словами, каждый знает то, что он знает, по-своему. И пусть я остаюсь приверженкой рациональности, доказательности и здравого смысла, я уважаю право других людей ставить во главу угла опыт или веру.

С тех пор как Эли Паризер ввел в оборот понятие «пузырь фильтров» [16], многие успели с грустью убедиться в их реальности. С политической точки зрения пузыри опасны, особенно на таких платформах, как Фейсбук. Каково это — не иметь доступа к отличным мнениям? Многие исследователи, занимающиеся этим вопросом, сталкиваются с тем, что люди и без всяких алгоритмов охотно отгораживают себя от всего, что им не близко. Они с радостью замыкаются в мире, где все им знакомо. Так должны ли рекомендательные сервисы предлагать пользователям новую информацию? Что это — просвещение или это новый способ вербовки? Является ли это формой пропаганды, которой надо противостоять? И что делать, если мнения, которые нам предлагают, так радикально отличаются от наших?

В книге «В поиске альтернативных фактов» [17] моя коллега Франческа Триподи рассказывает, как она в рамках своего исследования сообщества евангелистов в Вирджинии посещала их воскресную школу. Однажды пастор, целый час до этого анализировавший отрывок из Библии, неожиданно обратился к обсуждению нового на тот момент билля о налоговой реформе [18]. Погрузив своих прихожан в контекст конкретного фрагмента Писания, пастор ловко подтолкнул их к тому, чтобы перенести принципы библейской экзегезы на предложенный политический текст. Такая стратегия интерпретации привела к тому, что прихожане прочли билль совсем другими глазами, чем люди, активно следящие за политической повесткой, и пришли к разительно отличным выводам.

Франческа дальше описывает, как эти принципы экзегезы работают при обращении к Гуглу. Вместо того чтобы использовать его для поиска информацию по теме, многие консерваторы-евангелисты, за которыми она наблюдала, с его помощью проясняли и подтверждали услышанное ранее. Духовные лидеры сообщества — от пасторов до радиоведущих — своими формулировками подталкивали паству к конкретным поисковым запросам. Другие формулировки для запросов никто не предлагал, дальнейшее изучение вопроса не предполагалось. Гуглишь «правильные» слова — поисковик выдавает «правильный» результат. «Неверный» запрос — «неверная» информация. Если член сообщества держит в голове «правильную» формулировку, то группам интересов ничего не стоит вывести наверх страницы тот контент, который, введи пользователь другой запрос, он бы никогда не увидел.

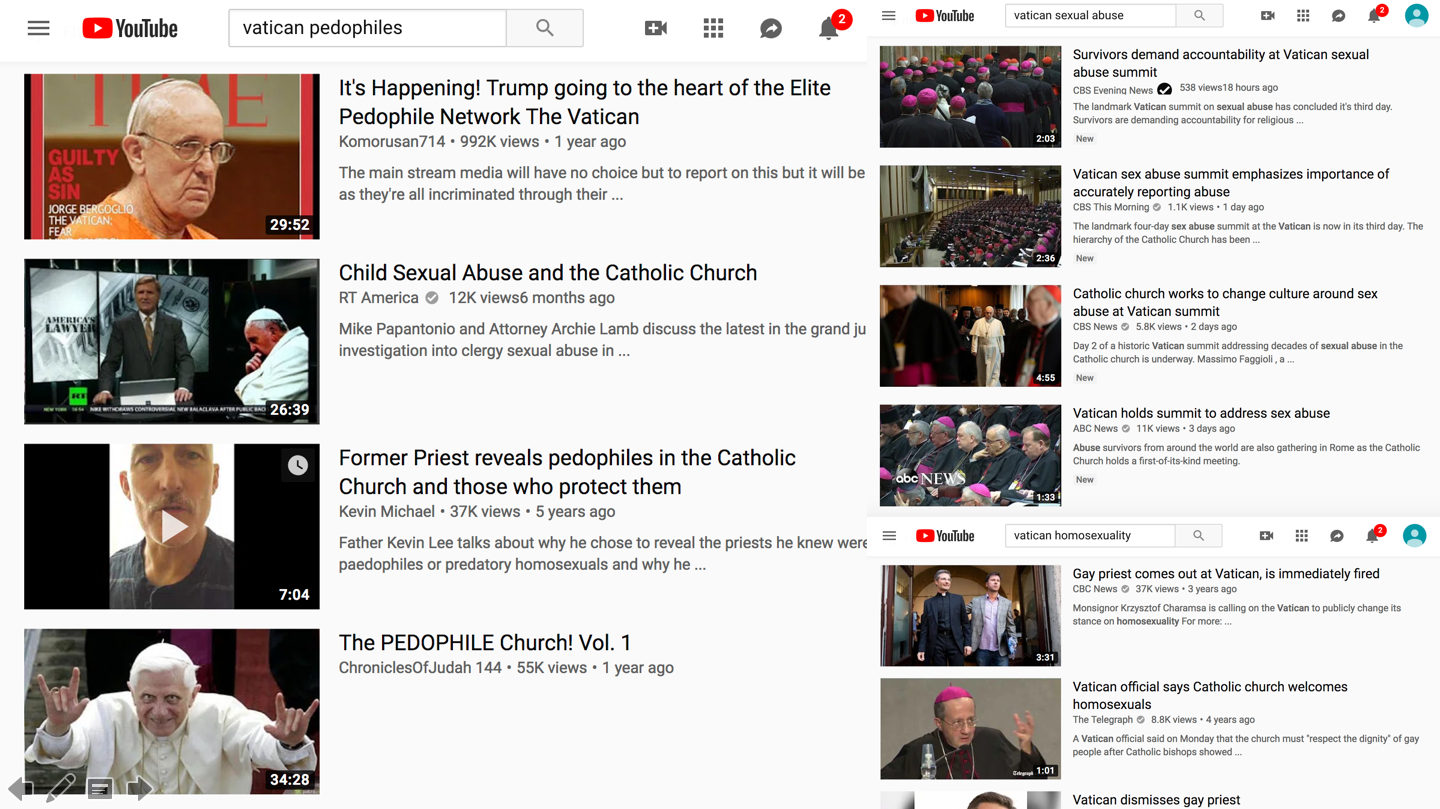

Это важно, потому что от отправной точки зависит весь дальнейший поиск. Причина этого как в архитектуре поисковиков, так и в том, как люди каждый по-своему подходят к процессу поиска. Вот, например, какая разная выдача вас ждет, если забить на Ютубе «педофилы в Ватикане» и «гомосексуалы в Ватикане».

С одной стороны, Ютуб поступает очень ответственно, четко разделяя результаты этих запросов. В конце концов, очень опасно валить в одну кучу гомосексуальность и педофилию. Но, с другой стороны, это значит, что человек, пытающийся найти информацию о недавних скандалах, связанных с Католической церковью, в зависимости от формулировки запроса попадет в один из двух совершенно разных информационных миров. Изначальный запрос полностью определяет путь вашего исследования. Весь контекст, вся работа рекомендательного сервиса — абсолютно все зависит от вашего первоначального запроса.

Общаясь во время праймериз с

Но это не то, для чего Гугл (и Ютуб) были придуманы. Когда рассказываешь инженерам из Гугла, как люди пользуются их поисковиком, у них крыша едет. Гугл должен быть не либеральным или консервативным, а информативным. Его эпистемология основана на допущении, что знание заключено в информации. Поисковики устроены таким образом, чтобы пользователь прокликал себе путь к искомому контенту, а не просто читал заголовки. Эта проблема возникает не впервые. Те, кто работает в журналистике, знают о дилемме заголовков. Должно ли они побудить прочесть материал, или их прочтения должно быть достаточно? Какой будет ваша картина мира, если вы читаете кучу кликбейтных заголовков и при этом ни на один не кликаете? И так не только с заголовками. Прибавьте сюда, как люди ориентируются в мире посредством push-уведомлений от Фейсбука и Твиттера. Недостоверная информация воздействует на нас не только через контент, но и через весь его контекст. И манипуляторы знают, как этим воспользоваться.

Начнем сначала

С проблемой недостоверной информации мы сталкиваемся не впервые, как и с манипуляциями с медиа. Стоит новому медиа обрести влияние, как появляются люди, желающие воспользоваться им в своих целях — в экономических, идеологических или политических. Разрабатывая систему, програмисты надеются, что она будет использоваться определенным образом и никак иначе. Так же и журналисты пишут, надеясь, что их информацию прочтут так, как они запланировали. И законодатели, предлагая поправки, надеются, что ситуация изменится именно так, как они предполагают. Создавая что-то новое, люди любят представлять, сколько всего хорошего принесут их творения. Но им не нравится думать о том, что их произведениями могут воспользоваться в корыстных целях.

Как бы я хотела, чтобы мы научились заранее видеть слабые места! Я с уважением отношусь к службам безопасности, которые тратят время на изучение уязвимостей системы, с тем чтобы сделать ее более защищенной от действий злоумышленников. Я считаю, что всем нам, в частности новостникам, нужно усвоить простую максиму: чтобы сделать свой продукт лучше, всегда думай о том, что может с ним пойти не так. Это очень трудная организационная задача — выстроить такую систему, в которой люди смогут одновременно представлять и образ идеального будущего, и все те ужасные последствия, которыми чревата недальновидность. Размышляя о наших культурных войнах [19], мы не стараемся отыскать пути для примирения сторон — это слишком сложно. Нам достаточно найти виноватых и высказать, чем мы недовольны. И сегодня, говоря о технологиях, мы должны помнить, что, даже если технологии помогают раздувать культурные войны, разворачивающиеся у нас на глазах, не они их создали.

Корень культурных войн — в эпистемологической разорванности. Иными словами, то, что люди по-разному строят свою картину мира, теперь разрывает ткань нашего общества. Этот разрыв виден сразу на многих уровнях, но особенно бросается в глаза в политике и медиа. Вот как это работает в сфере новостного вещания. Понятно, что зрители Fox и зрители CNN видят мир по-разному. Беспокоит, что они все меньше и меньше знают друг друга. Не менее тревожно и то, что пропали структуры, которые раньше связывали эти новостные источники.

Большую роль в сохранении цельности нашей социальной ткани играли местные новости. Многие в первую очередь обращают внимание на содержание новостей, особенно сами журналисты, и хорошо, что обращают. Но я хочу отметить и структурную функцию, которую выполняли локальные медиа. На местном уровне зрители в лицо знали тех, кто производит новости. Если ты не знаешь никого из новостей, ты теряешь доверие к новостям в принципе. Новостники становятся чужаками. Местные новости были мостиком к федеральным. Они предоставляли для них контекст. Задача была не только в том, чтобы рассказать о местных событиях. Важно было осуществить эту понятийную сцепку. Местные новости не давали эпистемологическим различиям расползтись. Даже в больших городах, в которых была россыпь газет, представляющих разные точки зрения, местные новости позволяли окинуть взглядом весь спектр мнений внутри сообщества. Это скорее общественно значимый проект, чем доходный бизнес. Совсем не то, о чем грезят в

В 1980-е, ставшие эпохой поглощений, финансисты пожирали местные новостные компании для получения их недвижимости, попутно сводя на нет их значимость для сообщества. Не развитие технологий погубило локальные медиа. Конечно, технологии повлияли на положение дел в этой сфере, но действия финансистов обрекли местные новости на провал задолго до появления интернета. Во многом модель крупных IT-компании задумывалась с учетом вызовов культуры поглощений 1980-х. Поэтому они так обеспокоены тем, чтобы сохранить контроль над акциями и не допустить до управления хедж-фонды и частных инвесторов. Технари твердо убеждены, что сами они все сделают лучше и правильнее. Во многом поэтому мы и пришли сейчас к тому, о чем мы сегодня говорим. Проблема технарей в том, что они в основном фокусируются на абстракциях — цифрах, охватах и особенно на количественном росте. Когда вы нацелены на абстрактные показатели, вы упускаете из виду локальные ценности и их особенности. Тот, кто не укоренен в сообществе, не сможет произвести региональный информационный контент. Технология умеет универсализировать, умеет увеличивать охват, но ей не дано достучаться до небольших сообществ. И в этом одна из причин наблюдаемой нами эпистемологической разорванности. Чем абстрактнее и обобщеннее становится информация, тем больше дробится общество. Эпистемологические разрывы разобщают.

Наше общество не просто разделено, оно разорвано, и разрывы ширятся день ото дня. У нас есть возможность окружать себя только людьми, схожими с нами. Мы обычно так и поступаем. Тут дело не только в

Война способствует сплочению общества, отчасти потому, что вооруженные силы тоже являются общественно значимым проектом. Здесь учатся быть в ответе друг за друга, сближаться, несмотря на различия, жертвовать жизнью ради других людей, пусть отличных от вас, но связанных с вами общей целью. Это и значит быть солдатом. На самом деле в национальных масштабах у нас есть такие проекты: наши университеты, армия и иные структуры, которые сближают разных людей и наделяют их взаимной ответственностью, что позволяет им выстраивать сложно организованные сообщества. Конечно, все эти проекты в той или иной степени уязвимы.

Многие из вас являются частью какого-то сообщества. Многие из вас знают, как сплотить людей вокруг общей цели. И это ключевой навык, нужный нам сегодня больше, чем когда-либо. Необходимо понимать, что дело не только в том, чтобы координировать общие усилия для решения поставленной задачи. Важно осознанно сплетать социальные связи, сшивать лежащую в основании сообщества социальную ткань. Фейсбук может считать, будто он задает коммуникационную сетку, которая стягивает нашу страну. Но это вы, участники сообществ, вы должны протягивать эти связующие нити. И вы должны делать это с умом. Причем соединять ими следует не только похожих между собой людей, но и отличных друг от друга. И работая с такими феноменами, как Ютуб, стоит направлять усилия не на фильтрацию контента, а на выстраивание сетевых сообществ, к которым пользователь может обратиться. Сообществ, которым можно задавать вопросы, которые помогут вам разобраться и которым вы будете доверять.

Вот почему мне так радостно прочитать рекомендации, которые дает комиссии Найта в своем отчете [21]. Комиссия говорит о приверженности ценностям общественного служения. Речь о том, чтобы отдать долг стране, и отдать его можно в том числе налаживая сетевые связи между гражданами этой страны. Это напоминает построение в шеренгу в армии. Представьте людей, фундаментально отличающихся друг от друга, но собирающихся вместе, чтобы плечом к плечу работать над общим делом. Представьте, что можно целенаправленно формировать коллективы не по общим взглядам и не из принципа культурного разнообразия, но намеренно сближая разных людей и разные сообщества.

В заключение я хочу сказать: правда разорвана. И она продолжит разрываться, пока мы не осознаем, что корень проблемы не в самой информации, а в том, каким образом мы выстраиваем нашу картину мира. Хотя имеющиеся прорехи в нашей информационной экосистеме можно наскоро заклеить одним из «пластырей», находящихся в нашем распоряжении, по-настоящему восстановить социальную ткань можно, только поставив во главу угла сообщества, в которых мы живем. Нужно понять, что информация — это мостик, соединяющий сообщества, и разумно распорядиться этим знанием. Чтобы совладать с теми проблемами новых медиа, которые я здесь упоминала, вам следует вернуться к самим сообществам. Многие из нас — тех, кто выстраивал работу социальных медиа, — воображали, будто для налаживания связей достаточно будет создать онлайн-платформы. Мы ошиблись. Социальные медиа сами не справятся. Не справится с этим и более качественный контент. Для налаживания подлинных связей нужно, чтобы сообщества сосредоточились на создании проектов, которые сведут людей вместе.

Большое спасибо.

Примечания

[1] Курсивные примечания в круглых скобках принадлежат дэне. — Здесь и далее примечания переводчика.

[2] Марк Цукерберг и Джек Дорси давали показания в Конгрессе США в апреле и сентябре 2018 года соответственно. Допросы были связаны с предполагаемым вмешательством российских спецслужб в президентские выборы 2016 года.

[3] Пьюдипай окончательно уступил первенство индийскому музыкальному каналу T-Series в апреле 2019 года.

[4] Теракт в городе Крайстчерч произошел 15 марта 2019 года. 28-летний австралиец Брентон Таррант, одержимый идеей о том, что иммигранты-мусульмане скоро вытеснят белое население Австралии и Новой Зеландии, открыл стрельбу в двух мечетях города, убив 51 человека и ранив 40.

[5] В этот день во время службы Девин Келли, разжалованный военный, открыл стрельбу в баптистской церкви. По словам знакомых, Келли презирал верующих и был носителем агрессивного атеистического мировоззрения. В результате нападения погибло 26 человек, 20 получили ранения, сам Келли застрелился.

[6] Крупнейшая в Америке онлайн-площадка по продаже и покупке недвижимости.

[7] То есть в Конгрессе.

[8] 14 декабря 2012 года в Ньютауне, штат Коннектикут, двадцатилетний Адам Лэнза сначала дома убил свою мать, а затем приехал в местную начальную школу, где застрелил 26 человек и ранил двоих, после чего покончил с собой. Большинство погибших — дети шести-семи лет.

[9] Deep state — согласно теории заговора, особенно распространенной в 2017 году, теневое правительство США, которое, не будучи публично представлено и выбрано демократическим путем, имеет решающее влияние на американскую политику, в частности пытается контролировать решения президента Трампа.

[10] 14 февраля 2018 года в старшей школе «Марджори Стоунман Дуглас» в городе Паркленд, штат Флорида, произошло массовое убийство учеников. Погибло 17 человек, убийца, девятнадцатилетний Николас Круз, был задержан. Трагедия вызвала всплеск конспирологических настроений, которые разделяли в том числе некоторые официальные лица: утверждалось, что стрельбы не было и что все это часть кампании, направленной против свободы ношения оружия. Выжившие ученики, рассказывавшие о событии на камеру, были объявлены «подставными жертвами» и подвергались травле в интернете. За распространением конспирологических теорий в интернете, по мнению ряда американских экспертных организаций, стояли русские боты и связанные с Россией аккаунты в Твиттере и других социальных медиа.

[11] Инцелы (от involuntary celibates — «невольный целибат») — люди, считающие себя несправедливо лишенными сексуальной жизни и возлагающие вину за это преимущественно на женщин, которые, по их мнению, «ведутся» только на состоятельных и красивых мужчин. Подавляющее большинство инцелов — белые гетеросексуальные мужчины. Считается, что по крайней мере четыре массовых убийства в США были совершены по мотивам, связанным с идеологией инцелов. Возможно, самым известным был случай Элиота Роджера, который устроил стрельбу в

[12] «Караваном» называют поток беженцев (от семи до десяти тысяч человек), который в октябре 2018 года, спасаясь от нищеты и преступности, двинулся из Гондураса к южным границам США, а также все последующие массовые миграции в США из Латинской Америки. Отношение к мигрантам все время президентства Трампа раскалывало американское общество, а праворадикалы использовали риторику против «караванов», чтобы продемонстрировать опасность, якобы грозящую белым американцам со стороны нелегальных иммигрантов.

[13] «Геноцид белых» — теория заговора, распространенная в основном в США и утверждающая, что существует организованная программа поддержки рождаемости небелого населения с целью замещения им белых. Организацией «геноцида», по мнению радикалов, занимаются, конечно же, евреи. Один из ключевых сюжетов этой теории — якобы имеющая место дискриминация белых в ЮАР. Сочувствие «угнетенным» белым в Южной Африке высказывали и Дональд Трамп, и «Россия-24».

[14] Lewis R. Alternative Influence: Broadcasting the Reactionary Right on YouTube. https://datasociety.net/library/alternative-influence.

[15] В русском языке американское сокращение SJW (Social justice warrior) хорошо прижилось, и теперь так пренебрежительно называют тех, кто настойчиво и порой даже агрессивно продвигает идеи мультикультурализма, феминизма четвертой волны, гендерного равенства и т. д.

[16] Понятие «пузыря фильтров» (filter bubble) описывает ситуацию, в которой результаты поисковых запросов или ленты социальных сетей вследствие работы алгоритмов выстраиваются исходя из истории предыдущих запросов и взаимодействий пользователя. Таким образом, пользователь как бы оказывается заперт внутри персонализированной выдачи и не видит тех сообщений или результатов поиска, которые видят пользователи с другой историей.

[17] Tripodi F. Searching for Alternative Facts: Analyzing Scriptural Inference in Conservative News Practices. https://datasociety.net/library/searching-for-alternative-facts/.

[18] Судя по времени проведения полевых исследований Триподи, речь идет о крупной налоговой реформе, инициированной Дональдом Трампом и со скрипом одобренной Конгрессом в декабре 2017 года. Реформа предполагает существенное снижение корпоративных налогов. Критики считают, что от реформы выиграет только крупный бизнес.

[19] После выхода в 1991 году книги Джеймса Хантера «Культурные войны: борьба за определение Америки» так стали называть идеологические конфликты между консервативным и либеральным крыльями американского общества по принципиальным вопросам, среди которых право на аборт, право на ношение оружия, права сексуальных меньшинств, иммиграция, феминизм, изменения климата, легализация рекреационных наркотиков и т. д.

[20] Эхо-камерами называют ситуации, когда определенным образом интерпретированная информация или идеи циркулируют внутри сообщества, куда не попадает альтернативная информация (например, внутри аудитории конкретного медиа). В результате идеи и подходы никогда не встречают критику и только усиливают влияние внутри сообщества.

[21] Crisis in Democracy: Renewing Trust in America. https://csreports.aspeninstitute.org/Knight-Commission-TMD/2019/report.