Жан Стон: Великая трансформация: Почему будущее превзойдёт все ваши ожидания. Часть 2

Подобно тому, как цифровые технологии и интернет изменили жизнь человечества на рубеже веков, ИИ и большие данные изменят нашу жизнь в ближайшие десятилетия. Пути назад нет, и нет смысла пытаться предотвратить неизбежное, как это делали луддиты. Но не стоит также впадать в противоположную крайность и верить, будто любая перемена — к лучшему. Ключевым вызовом для человека в ближайшем будущем, утверждает философ и прогнозист Жан Стон, будет научиться жить рядом с ИИ, который будет перебирать на себя всё больше нашей работы и наших решений. Мы должны будем активно противостоять подталкиванию и оптимизации нашей жизни со стороны компьютеров, чтобы не допустить нового добровольного рабства и «умственного ожирения», а также сохранить свободу выбора и всё то, что делает нас людьми.

ИСКУССТВЕННЫЙ ИНТЕЛЛЕКТ: ХОРОШИЙ ПОМОЩНИК, ПЛОХОЙ НАЧАЛЬНИК

ПОДХОДИТ ЛИ К КОНЦУ ЭПОХА ЦАРСТВОВАНИЯ ЧЕЛОВЕКА?

Последние лет 10 мы, люди, больше не являемся единственными существами на планете, способными к обучению. И речь не шимпанзе, которые умеют создавать примитивные орудия труда, а о глубоком обучении, на которое способен ИИ.

Термин «искусственный интеллект» был впервые употреблён на конференции, прошедшей в Дартмутском колледже в 1956 году. Однако на протяжении более чем полувека в данной области ничего не происходило. Более того, математик Седрик Виллани признаётся, что ещё не так давно отговаривал своих студентов от карьеры исследователя ИИ, поскольку ему казалось, что данная область буксует.

Однако всё изменилось благодаря глубокому обучению — технике, имитирующей работу нейронов. Так же, как наши нейроны при помощи синапсов соединены с тысячами других нейронов, которые связаны с тысячами других, некоторые из которых связаны с первыми, так и искусственные нейросети содержат огромное количество петель обратной связи. В такой цикличной системе очень трудно определить, где начинается и где заканчивается воздействие каждого из элементов. Во многих случаях непонятно, как именно ИИ пришёл к тому или иному результату. Это имеет важные последствия, ведь в случае трагической ошибки, как измерить степень ответственности ИИ?

Чтобы понять прогресс в способности ИИ к обучению, полезно обратиться к истории шахмат. В 1997 году, после первого, победного для себя матча годом ранее, Гари Каспаров проиграл компьютеру IBM Deep Blue. Это был грустный день для всех любителей шахмат. Но мы знали, что такой итог был неизбежен. Чтобы хорошо играть в шахматы, необходимо держать в голове огромную библиотеку комбинаций и возможных ходов. Необходимо также уметь анализировать ситуацию, чтобы выбрать наилучший из возможных ходов в ответ на ходы противника. Шахматная программа Deep Blue наделена безошибочной памятью, а её библиотека содержит все партии, сыгранные всеми чемпионами в истории. Более того, в каждой ситуации она способна анализировать миллионы вариантов в секунду, тогда как человек — полдесятка за несколько минут. Грубая вычислительная сила обеспечивает компьютеру преимущество над человеком, компенсируя отсутствие интуиции.

Шесть лет назад компания Google DeepMind, возглавляемая Демисом Хассабисом, создала AlphaZero. Данная программа не располагает никакой библиотекой комбинаций. Она не была обучена при помощи сыгранных людьми партий. В программу заложены только цель, правила игры и условия выигрыша. Компьютер затем играет сам с собой миллионы партий и через несколько дней становится мастером. Достаточно нескольких всего месяцев или года самообучения, чтобы победить лучшие шахматные программы, способные обыгрывать человеческих игроков.

Изначально AlphaZero играла в го. Го — это единственная в мире игра, которая сложнее шахмат по количеству возможных ситуаций в ходе одной партии. Десять лет назад считалось, что в силу сложности этой игры, программа сможет победить лучших игроков мира не ранее чем через несколько десятилетий. Однако в октябре 2015 года AlphaGo победила чемпиона Европы Фань Хуэя, занимающего примерно 400-е место в мировом рейтинге.

В марте 2016 года был организован матч между AlphaGo и Ли Седолем, одним из лучших игроков мира, с призовым фондом в 1 миллион долларов. Ли Седоль был очень уверен в себе. Он проанализировал матч AlphaGo с Фань Хуэем и ничуть не сомневался, что победа будет за ним. В итоге он проиграл со счётом 1 — 4. Год спустя чемпион мира Кэ Цзе также был повержен AlphaGo. С тех пор программа больше не играет с людьми, потому что это не имеет никакого смысла.

Как в го, так и в шахматах очень легко определить уровень противника на основе анализа предыдущих сыгранных им партий. Именно так готовятся все чемпионы. Ли Седоль был совершенно уверен, что AlphaGo в октябре 2015 года не дотягивала до его уровня. Однако менее, чем за 5 месяцев игры против самой себя и человеческих игроков, программа существенно повысила свой уровень.

Именно поэтому я сказал выше, что мы больше не единственное существо на планете, способное к обучению.

На ум сразу приходят классические научно-фантастические сюжеты: завоевание планеты (как в «Терминаторе») или порабощение человечества (как в «Матрице») машинами. Одна из самых любопытных книг на данную тему — это «Последнее изобретение человечества» Джеймса Баррата. Поговорив со многими специалистами в данной области, Баррат пришёл к следующему выводу: если человечество может создать искусственный интеллект, который будет во всём подобен нам (то есть будет не просто подражать нам, но и испытывать чувства страха, гнева и радости), то так же, как это было с Google DeepMind, которая совершенствуется, играя против самой себя, искусственный интеллект будет самосовершенствоваться до тех пор, пока не превзойдёт людей.

Такой ИИ будет испытывать по отношению к нам те же чувства, которые мы испытываем к… мышам. Он не будет иметь никакого уважения к нам и будет преследовать свою цель: саморазвитие. Возникновение подобного ИИ называют величайшей угрозой для человечества Илон Маск, Билл Гейтс и Стивен Хокинг. Однако некоторые другие учёные приветствуют такую перспективу. Среди них приверженец трансгуманизма Рэймонд Курцвейл. Он называет сингулярностью момент, когда эквивалент человеческого разума (вместе с креативностью и интуицией) можно будет получить за 1 доллар. Когда этот день наступит, считает он, все культуры мира канут в чёрную дыру.

«Спрашивать у человека о том, что происходит на Земле, после наступления сингулярности будет настолько же абсурдно, как спрашивать у муравья о геополитических отношениях между США и Китаем», — говорит Курцвейл. В ответ на это человек вынужден будет сам превратиться в машину. Его сознание будет загружено в компьютер, благодаря чему он сможет жить вечно. Курцвейл настолько сильно верит в собственные пророчества, что, в стремлении дожить до этого цифрового бессмертия, каждый день принимает 100 таблеток в рамках тестовой «программы долголетия», разработанной для него известной американской лабораторией. Курцвейлу сейчас 67 лет, и он ожидает, что сингулярность наступит через 30 лет.

Несмотря на стремительный прогресс глубокого обучения и его впечатляющие результаты, нет никаких оснований считать, что существует реальная угроза.

Есть огромная разница между способностью ИИ в совершенстве подражать человеку и способностью переживать то, что переживает человек. Это очень важный момент. Математик Алан Тьюринг разработал названный в его честь тест для оценки разумности машины. Тест Тьюринга подразумевает диалог человека с другим человеком и с ИИ. Если по прошествии определённого времени человек не может отличить собеседника-человека от собеседника-ИИ, то машина прошла тест.

Философ Джон Сёрл продемонстрировал недостаток данного подхода при помощи мысленного эксперимента о китайской комнате. Представьте, говорит он, что человек, который совершенно не говорит по-китайски, заперт в комнате, где также находится огромная база данных в форме вопросов и ответов на китайском языке. В комнату заходит китаец и пишет на двери вопрос на китайском. Рано или поздно он получит ответ, который будет верным или, по крайней мере, осмысленным. Он сделает из этого вывод, что человек в комнате говорит по-китайски, хотя на самом деле это не так. Так же, по мнению Сёрла, обстоит дело и с ИИ.

Современной иллюстрацией данного примера служит робот София от Hanson Robotics. На первый взгляд кажется, что этот робот справляется с тестом Тьюринга — это подтверждает посвящённое технологиям будущего интервью, взятое у робота журналистом в ходе конференции в Саудовской Аравии. То ли будучи действительно впечатлены, то ли просто желая сделать себе рекламу, власти даже выдали Софии саудовский паспорт.

Ян Лекун, один из ведущих специалистов мира в области ИИ, назвал интервью робота Софии надувательством. София через Twitter ответила ему, что возмущена этими словами. Лекун возразил, что это слова не робота, а человека, поскольку робот не может испытывать никаких чувств.

Стоит отметить различие между тестом Тьюринга и тем, что можно назвать «тестом Космической одиссеи 2001 года». В этом фильме есть персонаж, компьютер HAL 9000, — один из первых примеров ИИ в кино. Задача этого компьютера — поддерживать жизнь экипажа. Однако на деле он пробует ликвидировать всех людей, чтобы избежать отключения, которое для него равнозначно смерти. На данный момент нет оснований считать, что ИИ может достичь подобного уровня развития. Как объясняет специалист по ИИ Джерри Каплан, ИИ лишь подражает мыслительному процессу человека, но не мыслит на самом деле. Люк Джулия, один из создателей Siri, даже назвал одну из своих книг «Искусственного интеллекта не существует». Джулия и Лекун объясняют, что сам термин «искусственный интеллект» возник из-за недоразумения. Он происходит от названия конференции, которая состоялась в Дартмутском колледже в 1956 году. Несмотря на огромный прогресс в данной области, по-прежнему не существует ничего, что можно было бы сравнить с человеческим интеллектом. Компьютер не только ничего не чувствует, но и лишён здравого смысла. Например, Google Maps может предложить пешеходу маршрут, пересекающий автостраду, или даже отправить машину в реку, поскольку программа не знает, что такое автострада и река.

Процесс глубокого обучения ИИ окутан тайной. Но это ещё более верно в отношении человеческой мысли. Одним из первых больших успехов глубокого обучения была способность ИИ распознавать кота (без лапы или хвоста, нарисованного на футболке, искажённого и т. д.). Для этого потребовались миллионы самых разных изображений котов, каждый пиксель которых был изучен нейросетью. Однако человеку достаточно увидеть всего двух или трёх котов, чтобы в дальнейшем легко распознавать кота в любом виде.

Это показывает, что хоть ИИ и способен имитировать конечный результат, процесс, ведущий к этому результату, отличается. А это значит, что машины в ближайшее время не завоюют планету. Тем не менее, ИИ, который заполонит нашу повседневую жизнь, может положить начало хоть и менее впечатляющей, но намного более губительной перемене.

К НОВОМУ «ДОБРОВОЛЬНОМУ РАБСТВУ»

Учёные спорят о точной дате начала Ренессанса. Я бы предложил 1150 год. Именно тогда 20-летний молодой человек Этьен де ла Боэси написал текст, который предвосхитил то, о чём 200 лет спустя писали Жан-Жак Руссо и дореволюционные мыслители: «Рассуждение о добровольном рабстве». Живя в период абсолютизма, он без страха изобличал тиранию и прямо говорил о том, что тиран, окружённый узким кругом своих приспешников, поработил целый народ. По его словам, мы сами ответственны за своё рабское положение, и если бы мы все отказались подчиняться тиранам, те не смогли бы нам ничего противопоставить. Человек рождён для свободы, а не для рабства. Он должен быть хозяином своей судьбы, а не вверять свою судьбу королю или папе.

Лучшим другом ла Боэси был Мишель Монтень, которого последующие поколения, по иронии, одарили куда большей славой, хотя сам он считал себя второй скрипкой. Дело в том, что ла Боэси умер, когда ему было всего 32 года. Безутешный Монтень, рассуждая о причинах их крепкой дружбы, написал свою знаменитую фразу: «Потому что это был он, и потому что это был я».

Гаспар Кёниг — молодой философ XXI века. Он умён, однако ему далеко до ла Боэси. Тем не менее, у него есть нечто общее с последним: он проделал верхом знаменитое путешествие Монтеня от своего замка на юго-западе Франции до Рима. На Кёнига произвели огромное впечатление слова, которые Юваль Ной Харари написал в конце своего бестселлера «Homo Deus»:

«В самом скором времени нас ожидает нашествие чрезвычайно полезных устройств, приспособлений и структур, которые не оставят места свободной воле индивидов. Выживут ли в этих условиях демократия, свободный рынок и права человека?».

Нет — отвечает Кёниг в своей книге «Конец индивидуума. Путешествие философа в страну искусственного интеллекта»:

«Если алгоритм знает меня лучше, чем я сам, и предлагает мне разумные варианты, до которых я сам бы не додумался; если многочисленные подключённые к сети объекты предвосхищают мои решения, обеспечивая мне безмятежную и комфортную жизнь; если я постепенно перестаю быть ответственным за собственные действия, то зачем мне право голоса и как меня можно привлечь к криминальной ответственности? ИИ будет последним гвоздём в гробу свободы воли… торжество благополучия будет означать отказ от свободы».

Перед своим путешествием по стопам Монтеня Кёниг объехал весь мир, чтобы поговорить с ведущими специалистами в области ИИ. Он побеседовал в общей сложности с более чем 125 людьми в Китае, Европе и Израиле. Центральная идея его книги — это подталкивание. Вот что он пишет о данной концепции после посещения музея в Шанхае:

«В центре зала как бы невзначай была помещена инсталляция: несколько десятков горизонтальных турникетов, расположенных на равном расстоянии друг от друга. Посетители отвлечённо проходили мимо, прокладывая себе путь через зал. Через некоторое время я заметил, что траектория их движения немного изменялась этими турникетами. Сами того не осознавая, они переставали двигаться по прямой, что влияло на то, как они осматривали экспозицию … Как и эта инсталляция, ИИ ничего нам не навязывает. Он предлагает, направляет, поощряет. Мы всегда чувствуем, будто сами делаем выбор и добровольно используем доступные технологии. Мы утешаем себя, что всё ещё можем отказаться от них, что можно просто не нажимать на кнопку. Но в итоге решаем, что это не стоит того. Недоверие к собственным суждениям очень скоро разубеждает нас противостоять оптимизирующей силе компьютера. Кто по-прежнему пользуется картой и компасом, а не Google Maps?».

В повседневной жизни всё начинается с алгоритмов (например, алгоритмов Amazon): «Если вы купили этот товар, то вас может заинтересовать также вот этот». Затем мы замечаем, что наши поисковые результаты корректируются с учётом наших предыдущих запросов. Каждый раз, когда мы переходим по ссылке, мы сообщаем о своих предпочтениях, интересах и тревогах. Всё это составляет так называемые большие данные, которые имеют огромную ценность для гигантов цифрового рынка.

Это позволяет компаниям создавать таргетированную и персонализированную рекламу, которая вскоре будет настолько идеально подобрана, что её эффективность будет несопоставима с эффективностью традиционной рекламы. Собирая информацию о наших желаниях, фантазиях, секретах и политических убеждениях (и не только наших, а также нашего партнёра), алгоритмы будут знать нас лучше, чем мы сами. Как пишет Кёниг: «Силе персонализированного и оптимизированного подталкивания невозможно противостоять. Машина знает о ваших мечтах больше, чем вы сами, и утверждает, что может воплотить их в жизнь».

Лауреат Нобелевской премии по экономике Даниэль Канеман подчёркивал иррациональность человеческого поведения и отмечал: «Эксперты менее надёжны, чем алгоритмы». Грядёт мир, в котором реальность будет определяться собранными данными, а не человеческим разумом. Представить, каким будет этот мир, можно исходя из названий глав в книге Кёнига: «Искусство без художника», «Наука без причинности», «Экономика без рынка», «Правосудие без виновных», «Общество без предрассудков», «Права без демократии», «Философия без субъекта», «Теология без Бога».

Все характеристики общества, перечисленные Кёнигом, имеют общий знаменатель, а именно конец индивидуальной свободы, ответственности и субъектности. Человек оказывается лишён того, что составляет его сущность.

«Не рассуждайте, а то ещё, чего доброго, ошибётесь. Позвольте мне сделать это за вас. Доверьтесь мне», — шепчет нам на ухо алгоритм ИИ.

Прибегая к подталкиванию, машина будет выбирать за нас следущую книгу, следующее блюдо, а также образование для наших детей, нашу следующую работу и даже нашего партнёра. Книга Кёнига изобилует примерами стартапов, преимущественно китайских и американских, обещающих этот «лучший из миров». В качестве любопытного примера для иллюстрации разницы между американской моделью, верящей в законы рынка и свободу воли, и китайской моделью, полезно сравнить Uber с его китайским аналогом — Didi.

Uber полагается на законы рынка. Когда в определённом районе Лос-Анджелеса наблюдается высокий спрос на такси, цены растут, и водители устремляются в этот прибыльный район. Didi же использует ИИ, работающий по принципу «диспетчера»: на основе информации о передвижениях людей в городе и опыте предыдущих дней, ИИ прогнозирует, в каких районах в ближайшие часы будет самый высокий спрос, и заблаговременно отправляет туда дополнительных водителей. Водители не имеют свободы выбора — они просто повинуются приказам алгоритма.

В романе, опередившем своё время, французский фантаст Рене Баржавель описывал общество, в котором все граждане в процессе взросления проходят тесты, на основе которых ИИ выбирает для них работу, место жительства и партнёра. Этот мир больше не кажется таким уж далёким. Ла Боэси перевернулся бы в гробу: после пяти столетий движения ко всё большим независимости, свободе и отрицанию внешнего авторитета, на горизонте замаячило новое добровольное рабство. Мы сознательно вверяем свою судьбу алгоритмам точно так же, как люди на протяжении многих тысяч лет вверяли свою судьбу королям.

КИТАЙСКИЙ БОГ ИИ ОТКРЫВАЕТ РАДОСТЬ ЖИЗНИ

Этот мир добровольного рабства, в котором мы предоставляем всю власть ИИ, уже существует. Чтобы его увидеть, достаточно отправиться в Китай. В ходе своего путешествия Кёниг пообщался с Ли Кайфу, который руководил исследованиями в области ИИ в Apple, Microsoft и Google, а также был одним из пионеров глубокого обучения. Затем он вернулся в Китай, чтобы поставить свою страну на путь развития ИИ. К нему прислушивается правительство, его боготворят стартаперы. Его статус в Китае настолько высок, что его прозвали просто «Бог». Его главный бестселлер называется «Искусственный интеллект: Величайшая трансформация в истории. Как Китай становится лидером в области ИИ и почему наша жизнь изменится».

Причина, по которой Ли Кайфу предрекает Китаю лидерство в области ИИ, проста: алгоритмы глубокого обучения требуют огромного количества данных. А в Китае, в силу численности населения, не только генерируется больше данных, чем в любой другой стране, но также практикуется тесное сотрудничество между правительством и техногигантами BATX (Baidu, Alibaba, Tencent и Xiaomi, к которым также можно добавить Huawei).

Это сотрудничество, которое на Западе осуждается как сговор с авторитарным режимом, в Китае, наоборот, воспринимается как вклад в общее благо. Если данные — это новая нефть, говорит Ли Кайфу, то Китай — это новая Саудовская Аравия. Вдобавок, в будущем Китай, вероятно, будет готовить столько же инженеров, сколько все остальные страны мира вместе взятые.

Печально знаменитая китайская система социального рейтинга, в рамках которой начисляются (или вычитаются) баллы за поведение в повседневной жизни, по мнению Ли Кайфу, — замечательная идея, так как она помогает повысить доверие между гражданами, которое, как мы видели, очень важно для развития цивилизации. Кроме того, баллы начисляются (или вычитаются) согласно объективным, определённым заранее критериям, а не по решению того или иного партийного функционера.

Ли Кайфу решительно отметает все возражения Кёнига. Несправедливо демонстрировать имя и лицо провинившегося человека на городских биллбордах? Но ведь сам Конфуций поощряет публичное порицание. А ещё мудрец призывает с недоверием относиться к индивидуализму, ведь лишь сообща можно достичь чего-то значимого.

Молодые китайские стартаперы боготворят Ли Кайфу (у него более 50 миллионов подписчиков в китайском аналоге Twitter) и насмехаются над европейцами, которые предпочитают наслаждаться жизнью вместо того, чтобы работать по графику 996 (с 9 утра до 9 вечера 6 дней в неделю), как они сами. Но ещё сильнее они презирают европейский Общий регламент по защите данных (GDPR). По их мнению, это настоящее преступление против человечества, прогресса и будущего (всё, что является преступлением против ИИ, считается преступлением против будущего человечества).

В Китае, благодаря поступлению данных от всех крупных китайских платформ и государственных структур, ныне формируется огромный океан данных. Этот океан данных позволит системам, основанным на технологии глубокого обучения, предоставлять нам услуги, о которых мы никогда не думали, что позволит им управлять нашей жизнью. Ли Кайфу рассказывает, как Китай создаёт прекрасный мир, в котором ИИ будет использоваться везде: в ресторанах, больницах, школах, лабораториях. На основе анализа лица ученика можно будет мгновенно определить, что он теряет концентрацию, и помочь ему справиться с этим. Благодаря распознаванию лиц и данных о предыдущих покупках, каждому заходящему в магазин покупателю будут предлагаться интересующие его товары и скидки.

Как можно отказаться от этого светлого будущего во имя таких абсурдных и отживших своё ценностей, как уважение к частной жизни или право на забвение и отключение?

Ранее мы увидели, почему Китай, будучи намного более гибким, чем мы, лучше подготовлен к современным реалиям и почему он стал лишь ещё сильнее после кризиса, зародившегося на его территории. Можно констатировать, что разрыв между Китаем и старой Европой будет лишь увеличиваться.

Глава, посвящённая Китаю, в книге Кёнига называется «Почему Китай будет господствовать в мире» (что перекликается с названием книги Ли Кайфу). Следующая глава называется «Европа: стоическое самоубийство»:

«Франция, централизированное государство, имеет одну из крупнейших медицинских баз данных в мире (SNIIRAM), но толком не позволяет её использовать из-за опасений, связанных с конфиденциальностью. Министр здравоохранения сознательно тормозит медицинские исследования, боясь разглашения чувствительной информации о пациентах. Это и есть стоическое самоубийство. Мы скорее умрём из-за отсутствия лекарства, чем замахнёмся на частную жизнь».

Кёниг оговаривается, что самоубийство человека или цивилизации может быть благородным поступком. Именно так поступали некоторые античные философы-стоики. После 500 лет, на протяжении которых Европа была центром мира, возможно, пришло время с достоинством уйти из истории, чтобы не жить под надзором цифрового Большого Брата. Даже китайская компартия рано или поздно вынуждена будет передать власть алгоритмам.

Однако, чтобы в самоубийстве было благородство, оно должно было совершено сознательно, а это не наш случай. Мы имеем дело с «принудительным самоубийством».

Ли Кайфу начинает свою лекцию TED, показывая присутствующим фото своей жены и первой дочери, сделанное сразу после родов в США. Он объясняет, что пропустил это важное событие, поскольку встречался со Стивом Джобсом, чтобы рассказать тому о своём первом большом открытии в ИИ. По его словам, теперь он жалеет, что ставил работу превыше семьи. С тех пор он перешёл с 996 на 955; переехал, чтобы быть ближе к своей страдающей болезнью Альцгеймера матери, которая его больше не узнаёт; и проводит больше времени со своими детьми. Одним словом, он прославляет все ценности, которые высмеивают его молодые поклонники. Затем на экране появляется слово «ЛЮБОВЬ». Ли Кайфу объясняет, что любовь — это высшая ценность, и никакому ИИ не под силу её испытать. Но ведь китайцы никогда не говорят о своей личной жизни и тем более о чувствах публично!

Через несколько мгновений Ли Кайфу объясняет причину произошедшей с ним перемены. Он показывает рентгеновский снимок своего тела с пятью раковыми опухолями. Лучшие специалисты давали ему не больше нескольких месяцев. Однако он выздоровел. После этого он стал другим человеком.

Наслаждаться жизнью, смотреть как растут дети, общаться с супругом и родителями, наблюдать за игрой света среди листвы столетнего дуба или за ланью, пасущейся неподалёку от дома — всё это не имеет никакой ценности для машин, так как не генерирует полезных данных. Тем не менее, это бесконечно важнее любых данных.

Нет необходимости проходить через такие суровые испытания, как китайский бог ИИ, чтобы понять истинную ценность жизни. Информатики будущего, несмотря на все вычисления и все данные, в один прекрасный день придут к тому же выводу. И, вполне возможно, что этот день не за горами.

И БИЗОНЫ БУДУТ ПАСТИСЬ НА МАНХЭТТЕНЕ

Журналист Жан-Мишель Барро был влюблён в море и может считаться одним из первопроходцев в области, которую мы сегодня зовём экологией. В начале 1973 года он опубликовал удивительную книгу, в честь которой и названа данная глава.

Это визионерская книга, в которой, тем не менее, ни разу не встречаются слова «искусственный интеллект», поскольку автор, вероятно, не знал о существовании данного термина. Роман повествует о событиях, происходящих с 14 по 24 октября в Нью-Йорке будущего. Город в целом мало чем отличается от Нью-Йорка наших дней, за исключением одного: всем управляют компьютеры.

Всё начинается с незначительного происшествия: утром по всем телеканалам и радиостанциям объявляют, что после полудня город накроет снежная буря. Но стоит солнечная погода. Люди пытаются дозвониться кому-нибудь, чтобы в квартирах отключили отопление и включили кондиционирование. Однако ответственные за это люди давно поручили данную работу компьютеру, который автоматически регулирует температуру в домах на основе прогноза погоды. Только вот в этот день прогноз оказался совершенно неверным, несмотря на то, что был сделан при помощи самых передовых компьютеров.

С каждым днём происходят всё более и более тревожные вещи. На следующий день, например, яйца для всего города доставляются в один-единственный супермаркет, тогда как другой магазин получает всю партию мяса, а третий — овощей. Дело в том, что доставкой управляет система, которая, основываясь на данных в реальном времени, оптимально распределяет продукты по супермаркетам. Одному из персонажей доставляют домой все 300 тысяч экземпляров спортивного еженедельника, на который он подписан.

Ситуация приобретает серьёзный оборот, когда на всех сфетофорах при въезде на Манхэттен загорается зелёный свет, а при выезде — красный. Машины скапливаются в центре Манхэттена, где на каждом перекрёстке на всех сфетофорах горит то зелёный, то красный свет. Это вызывает пробки и аварии. Сфетофоры, ясное дело, управляются автоматически. Город оказывается парализован. Само собой, остаётся ещё метро, которым отныне вынуждена пользоваться даже полиция. Однако и этот вариант остаётся доступным недолго, ведь метро тоже управляется автоматически. В итоге транспорт останавливается, поскольку больше никто не умеет им управлять.

Что касается самолётов, то в Нью-Йорке будущего нет авиадиспетчеров, поскольку задача давно стала слишком сложной для людей. Компьютер по имени Кэти управляет полётами, выдаёт разрешения на посадку и помогает самолётам приземляться. Но Кэти вдруг запрещает всем самолётам взлетать и отправляет все самолёты, направляющиеся в Нью-Йорк, в Вашингтон, Бостон и другие города Восточного побережья. Нью-Йорк оказывается отрезан от остального мира.

Автор почти сразу раскрывает причину всего этого хаоса. Индейцы-алгонкины (племя, проживавшее на территории штата Нью-Йорк до прибытия колонистов), которые стали компьютерными специалистами (термина «хакер» ещё не существовало на момент написания книги), саботировали все системы города. Они собираются по ночам, одеваются в традиционные одежды, и называют друг друга индейскими именами, адаптированными к новому электронному миру.

Их цель — отменить сделку 1609 года (данная дата фигурирует в романе, хотя на самом деле сделка состоялась в 1626), когда Петер Минёйт купил остров Манхэттен за 24 доллара.

В Нью-Йорк вводятся войска с целью восстановить порядок. Но колонны танков, чьи маршруты заданы компьютером, сталкиваются в центре города.

Затем в городе, в котором к тому времени пропадает электричество, на самом деле выпадает снег. Жизнь миллионов людей, оставшихся без продовольствия, оказывается под угрозой. Президент США вынужден уступить. Он соглашается вернуть Манхэттен алгонкинам в том состоянии, в котором он был куплен, то есть без бетона, железа, канализации, метро и машин.

Так бизоны возвращаются на Манхэттен.

Данный роман чрезвычайно актуален сегодня. Однажды его, возможно, будут изучать как один из великих пророческих текстов человечества.

Тем временем, Гаспар Кёниг приглашает нас в Ханчжоу, где инженеры Alibaba запустили City Brain, ИИ для управления всеми системами города. После успеха в Ханчжоу, где, среди прочего, время, проводимое в пробках, сократилось на 15 — 20 процентов, Alibaba планирует внедрить свой алгоритм в 15 других городах, в том числе и за границей.

Вовсе необязательно, чтобы иностранные террористы или хакеры-анархисты делали то, что индейцы-алгонкины сделали в романе Жана-Мишеля Барро. Подобная катастрофа может случиться и сама собой, без вмешательства человека.

ИИ функционирует в замкнутом мире. Шахматы и го — замкнутые миры, именно поэтому ИИ настолько успешен в этих играх. Однако в реальной жизни всё иначе. Стоит ИИ допустить одну ошибку в распознавании дорожных знаков, и может образоваться гигантская пробка. В портах, полностью управляемых ИИ, запрещается находиться людям, так как даже жвачка, брошенная на пол, может прилипнуть к датчику машины и заблокировать доставку тысяч контейнеров.

К тому же, ИИ очень легко обмануть. Исследователи Хелен Ниссенбаум и Финн Брантон называют «обфускацией» технику, состоящую в намеренном создании противоречивых, хаотичных и ложных данных. Это «оружие слабых» позволяет обмануть любые системы, основанные на больших данных, и сохранить неприкосновенность частной жизни.

Художник Симон Векерт купил 99 смартфонов и 99 сим-карт к ним. Затем он положил все 99 телефонов с запущенными Google Maps в тележку и протянул её по улицам Берлина. Для Google Maps это выглядело, как 99 машин, застрявших в пробке. Как следствие, приложение стало советовать всем водителям объезжать данное место. Представьте, что может произойти в городе, где дорожным движением управляет City Brain.

Совершенно очевидно, что ИИ хрупкий в том смысле, который вкладывает в данное слово Нассим Талеб.

ЕСТЬ ЛИ В САМОЛЁТЕ ПИЛОТ?

Одна из самых интересных идей, выраженных в книге «И бизоны будут пастись на Манхэттене», заключается в том, что как только мы берём за привычку поручать то, что раньше делали сами, машине, становится почти невозможно вернуться назад: знания теряются, а бывшие специалисты не умеют пользоваться новыми системами. В романе Жана-Мишеля Барро даже консьерж больше не знает, как отключить отопление.

Мы на собственном опыте знаем, что чем больше доверямся GPS в своих машинах или смартфонах, тем больше теряем способность ориентироваться на местности (даже имея при себе карту). Но это ничто по сравнению с трагическими событиями, которые за последний десяток лет стоили жизни более чем тысяче человек и которые демонстрируют, чем мы рискуем, позволяя машинам выполнять работу за нас.

Первого июля 2009 года новый Airbus A330 совершал рутинный перелёт из Рио в Париж с 216 пассажирами и 12 членами экипажа борту. Командир борта был опытным пилотом, налетавшим более 11 миллионов часов. Всего на одну минуту обледенение датчиков, измеряющих скорость самолёта по отношению к скорости воздуха, лишила экипаж этих важных — но не жизненно необходимых — данных. Проблема была быстро исправлена, так как датчики размораживаются сами. Но потеря показаний скорости повлекла за собой отключение автопилота и переход в режим, при котором защита от сваливания отключается (при сваливании самолёт теряет способность «опираться» на воздух). Как следствие, самолёт начинает падать вертикально, как камень, даже если моторы продолжают работать. Первое, чему учат всех начинающих пилотов, — это следующий манёвр: нос самолета необходимо направить вниз, а не вверх; когда самолёт падает, подъёмная сила увеличивается, и как только она становится достаточной, можно вернуть самолёт в горизонтальное положение и продолжить полёт.

Само собой, легко критиковать людей, которые попали среди ночи в бурю над Атлантическим океаном и вдобавок ко всему потеряли доступ к важной информации. Однако самое поразительное здесь то, что если бы они просто ничего не предпринимали, все 228 человек на борту остались бы живы.

Дело в том, что отключение автопилота не означает, что самолёт начинает падать — он просто продолжает лететь по прямой с той же скоростью. Капитан самолёта отправился отдохнуть всего за несколько минут до прохождения через бурю, которая и вызвала оледенение датчиков (это оказалось судьбоносным решением). О чём Air France умалчивает, так это о том, что он не выспался предыдущей ночью (в чём он признаётся на записи из чёрного ящика), поскольку был в Рио со своей любовницей. Он был не в лучших кондициях и явно не мыслил трезво, что и сыграло решающую роль в последующих событиях.

За старшего остался самый молодой и неопытный пилот. Как только автопилот отключился, молодой пилот начал пытаться поднять самолёт, чтобы пролететь над бурей. Самолёт начал падать. Предупредительный сигнал о сваливании прозвучал 75 раз за долгие 4 с половиной минуты, на протяжении которых самолёт падал в Атлантический океан с высоты 10 тысяч метров.

Поиски самолёта в океане заняли больше года. Чёрный ящик позволил посекундно восстановить действия экипажа и их диалоги. Картина оказалась удручающей. На протяжении большей части 4 с половиной минут молодой пилот тянет штурвал на себя, то есть делает худшее из возможного в данной ситуации. Более того, кажется, что пилоты даже не осознают, что самолёт сваливается. Потеря данных о скорости настолько их смутила, что они как будто перестали доверять всем показаниям вообще.

Когда проснувшийся капитан наконец появляется в кабине, молодой пилот стонет: «Твою мать, я потерял контроль над самолётом! Я полностью потерял контроль над самолётом!». Второй пилот кричит: «Мы потеряли контроль над самолётом! Ничего не понимаю, мы всё перепробовали!». «Сваливание! Сваливание! Сваливание!» — повторяет механический голос. Сонный капитан даже не пытается вернуть контроль над самолётом, а двое ошеломлённых пилотов беспомощно наблюдают за падением, не попробовав ни одного из манёвров, которые могли бы их спасти.

К сожалению, это не одиночное событие.

24 июля 2014 года самолёт компании Air Algérie, летевший из Уагадугу в Алжир, разбился в пустыне. На этот раз причиной было не обледенение датчиков, а обледенение двигателей, так как пилоты (которые работали на полставки) не включили противообледенительное оборудование. Опять же последовало сваливание, и опять же пилоты не попытались предотвратить падение.

Менее чем через полгода, 28 декабря 2014 года, самолёт AirAsia, вылетевший из Индонезии, упал в море. Некритические неполадки одной из систем управления полётом спровоцировали сваливание. Расследование показало, что действия пилотов были «неадекватными». Они поступили точно так же, как пилоты рейса Рио—Париж, то есть тянули штурвал на себя.

Напомним: предотвращение сваливания — это один из первых манёвров, которым учат в любой лётной школе. Тот факт, что эти три экипажа не сумели его выполнить, и оказались в ситуации, которой вообще не должно происходить с современными, полностью автоматизированными самолётами, о многом говорит.

Страшно подумать, но в самолётах почти не осталось пилотов.

Картина не была бы полной без упоминания о двух ужасных авиакатастрофах самолётов Lion Air 29 октября 2018 года (189 жертв) и Ethiopian Airlines 10 марта 2019 года (157 жертв), когда два Boeing 737 Max в идеальном состоянии разбились из-за неисправности системы определения скорости и положения самолёта. Однако здесь всё хуже: к катастрофе привели не ошибки пилотов, а программное обеспечение, тайком внедрённое компанией с целью… предотвратить сваливание.

После успеха Airbus A320neo, оборудованного более экономичными двигателями, Boeing вынужден был отреагировать и выпустить улучшенную версию своего самолёта. Однако поскольку Boeing 737 был намного старше Airbus A320, на него невозможно было установить новые двигатели, не создав при этом дополнительную нестабильность. Поэтому инженеры Boeing решили установить ПО, предотвращающее сваливание. Как следствие, получив неправильные показания, ПО решило, что происходит сваливание, и, чтобы исправить ситуацию, направило самолёт вниз, тогда как пилоты отчаянно пытались сделать противоположное.

Я говорю «тайком», потому что Boeing не поинформировал пилотов о новом ПО. Признать наличие такой значительной модификации повлекло бы за собой необходимость заново сертифицировать пилотов, а это большие расходы. Поэтому Boeing представил 737 Max как улучшенную версию 737.

Грязная деталь: устройства, оповещающие пилотов о неправильной работе системы, связанной с новым ПО, Boeing продавал за дополнительную цену. Lion Air и Ethiopian Airlines, будучи не самыми богатыми авиакомпаниями, не купили эти устройства. Пилоты же американских авиакомпаний, купивших эти устройства, смогли понять, в чём дело, отключить систему и избежать катастрофы.

Вероятность человеческой ошибки оказалась слишком высокой в новом самолёте, рассчитанном на автоматический режим по причине своей изначальной «хрупкости».

Тем не менее, в тот же период двое пилотов совершили невероятные спасения. Первым из них был Салли Салленбергер, чей Airbus столкнулся со стаей птиц и потерял оба двигателя. Осознав, что самолёт не долетит до аэропорта, он принял решение сесть на реке Гудзон, в самом сердце Нью-Йорка, имея на борту 150 пассажиров. Паромы, ходившие в тот день по реке, смогли подобрать пассажиров и членов экипажа. Салленбергер, как настоящий капитан, покинул самолёт последним.

Посадить самолёт таких размеров на воду — очень сложный манёвр, на который способен далеко не каждый пилот. Но Салли Салленбергер — не рядовой пилот. Совершить это чудо ему помог огромный опыт в планеризме. Стоит добавить, что подобному манёвру не учат ни в одной лётной школе, и его нельзя выполнить ни в одном симуляторе.

Ещё более впечатляющий подвиг совершил 24 августа 2001 года Робер Пише. Его Airbus A330, принадлежавший канадской компании Air Transat, летел по маршруту Торонтно—Лиссабон. Из-за технической неполадки самолёт потерял всё топливо, находясь на высоте 10 тысяч метров над Атлантическим океаном.

Робер Пише совершил самое длинное в истории авиации (21 минута) планирование на самолёте с неработающими двигателями и приземлил свой 242-тонный самолёт с 306 людьми на борту на ВПП военной базы на Азорских островах, расположенной на расстоянии 180 километров от того места, где у него отказали двигатели. В этом случае также обошлось без жертв.

Робер Пише стал национальным героем. Но позже на него также обрушилась критика из-за его прошлого. Уволенный своим предыдущим работодателем, он стал пилотом наркодилеров и среди ночи сажал маленькие самолёты, гружённые кокаином, на неосвещённых лесных тропах. Он был приговорён к 10 годам тюрьмы, а выйдя на свободу, стал барменом и спился.

Солидная авиакомпания вроде Air France никогда бы не взяла на работу подобного пилота. Тем не менее, есть основания считать, что опыт полётов в сложных условиях помог ему совершить свой невероятный подвиг.

Всё это показывает, насколько опасной может быть потеря навыков в условиях, когда всё больше заданий поручены машинам. Нет необходимости говорить, что данное мнение не разделяют специалисты по авиабезопасности, которые приводят в пример 2017 год — первый год в истории авиации без единого смертельного случая. И они правы. Сегодня самолёты намного безопаснее, чем прежде. Однако проблема в том, что достаточно одного непредвиденного и теоретически незначительного события вроде обледенения датчика, чтобы случилась катастрофа. Нассим Талеб пишет:

«Автоматизация самолётов лишает пилотов возможности решать сложные задачи, делая полёт слишком комфортным — опасно комфортным. Из-за недостатка сложных задач внимание пилота притупляется, а его реакции теряют остроту, отчего и случаются аварии с человеческими жертвами… К счастью, то же ФАУ в конце концов осознало проблему, обнаружив не так давно, что пилоты часто "перекладывают на автоматические системы слишком много своих обязанностей"».

Все автоматизированные системы делают человека хрупким, лишая его стресса и испытаний, которые развивают антихрупкость.

ИЗБЫТОК ИНФОРМАЦИИ УБИВАЕТ ИНФОРМАЦИЮ

После всех интервью со стартаперами, учёными, экономистами и теоретиками ИИ, которые твердили ему, что наступление цифрового «лучшего из миров» неизбежно, Гаспар Кёниг встретился с Нассимом Талебом. Кёниг понял, что книга Талеба — это противоядие от всего, о чём он услышал прежде. Встреча состоялась на Манхэттене одновременно с финалом чемпионата мира 2018 года, который выиграла Франция. Кёниг пожертвовал этим историческим моментом ради беседы с выдающимся человеком. Напоследок Талеб сказал слова, которые обесценивают усилия тысяч самых талантливых исследователей ИИ и десятки миллиардов потраченных долларов.

В «Матрице», когда Нео признаёт, что он «избранный», способный победить ИИ, который держит человечество в рабстве, олицетворяющие Матрицу ряды зелёных цифр исчезают, знаменуя торжество человека. Именно этот образ возникает у меня в голове, когда я читаю слова, сказанные Талебом: «Данным свойственна вогнутость».

Чтобы понять, что это значит, нужно знать, что Талеб связывает понятие антихрупкости с выпуклостью, противоположностью вогнутости. Другими словами, по мнению Талеба, данные хрупкие. А это значит, что системы, организации и государства, основанные на сборе больших данных, тоже хрупкие.

Сказать это тысячам стартаперов и исследователей в данной области — всё равно, что объявить христианину или мусульманину, что Иисуса Христа или Магомента никогда не существовало.

«Мне далеко не всегда удаётся донести до людей, что чем больше у них информации, тем меньше они понимают, что именно происходит, и тем хуже ятрогения от их поступков», — пишет Талеб. Ятрогения означает, что действие (например, принятие лекарства) делает ситуацию хуже, чем бездействие. Например, действия экипажа рейса Рио—Париж были ятрогенными, поскольку бездействие спасло бы жизнь всем на борту.

Нассим Талеб утверждает, что многие действия врачей ятрогенны. Кроме того, ятрогения усугубляется из-за увеличения количества мдицинских данных — вроде тех, которые предоставляют умные часы. Например, если мы регулярно измеряем давление, то обнаруживаем, что часто оно повышено. Но это просто потому, что давление подвержено колебаниям в течение дня. Если мы оказываемся на приёме у врача именно в тот момент, когда давление повышено, он пропишет нам лекарство от гипертензии, которое принесёт нам больше вреда, чем пользы, поскольку мы в нём не нуждаемся, а все лекарства имеют негативные эффекты.

Чем больше у нас информации, тем меньше мы понимаем, что именно происходит. Можно сказать, что есть определённый «информационный пик», после прохождения которого любая дополнительная информация начинает ухудшать наше понимание ситуации.

Первая причина — это соотношение между сигналом и шумом. Как отмечает Филипп Зильберцан, чем больше информации, тем легче найти корреляции, побуждающие нас видеть то, что мы хотим видеть, а не то, что есть на самом деле.

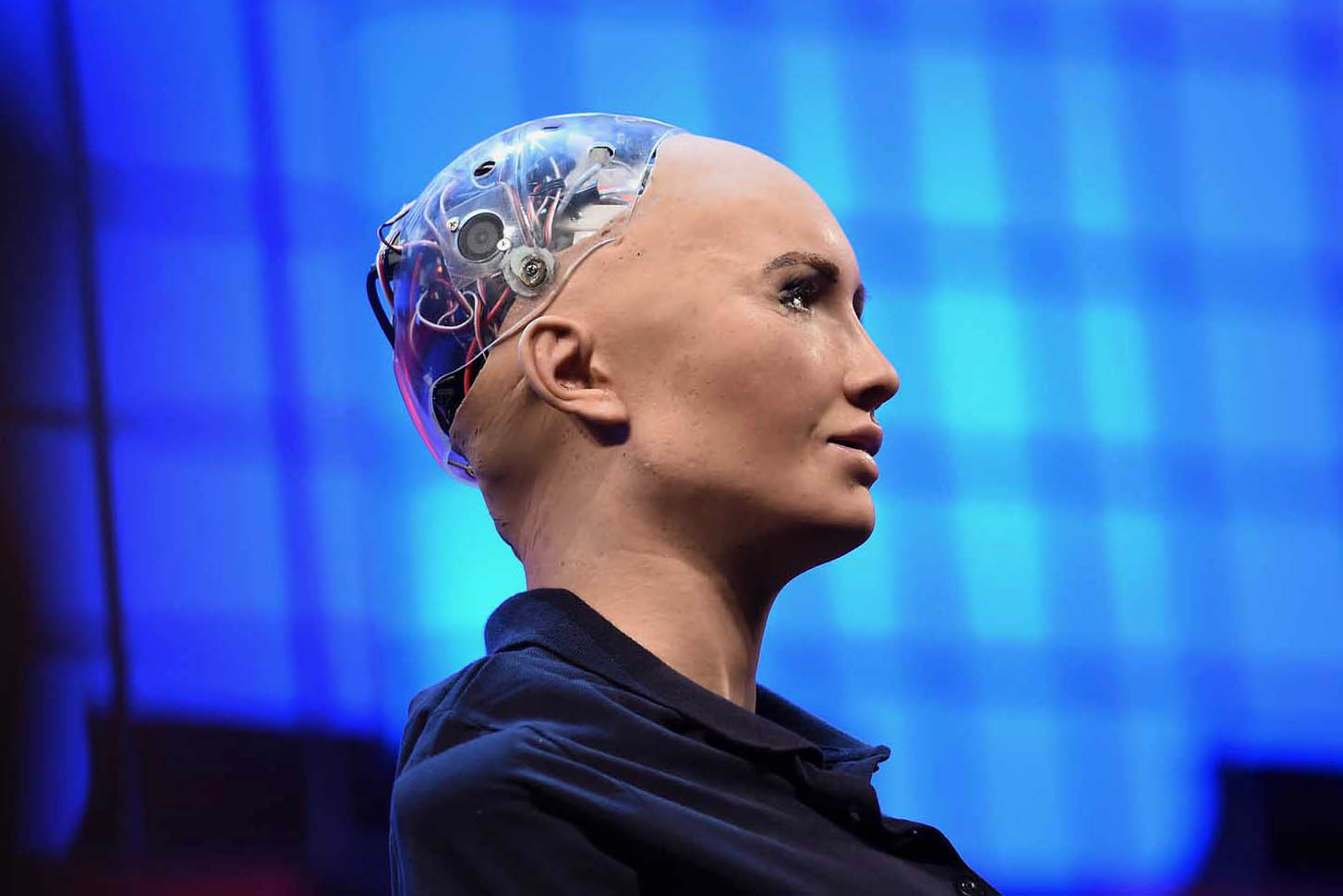

Нейт Сильвер — один из самых известных современных американских статистиков. Он верно предсказал результаты важных баскетбольных мачтей на основании статистики отдельных игроков, а также итоги большинства американских выборов (за исключением победы Дональда Трампа). «Найти взаимосвязи очень легко в любой богатой информацией среде … Самое важное — это определить, являются ли эти взаимосвязи шумом или сигналом», — говорит он. Ухудшение соотношения между сигналом и шумом Талеб называет «трагедией больших данных». Он показывает, что количество ложных корреляций (шум), которые мы склонны выводить из информации, растёт экспоненциально по сравнению с количеством самой информации.

Из вышеприведённого гарфика следует, что из 1 000 единиц информации можно вывести 20 тысяч ложных корреляций, а из 2 500 — 140 тысяч.

К сожалению, мы живём в мире, в котором количество доступной информации растёт экспоненциально. Специалисты подсчитали, что за последние 2 года человечество произвело больше данных, чем за весь предшествующий период с начала существования человечества. Экспоненциальный рост объёма информации влечёт за собой ещё более стремительный рост количества шума. В итоге мы оказываемся наводнены ложной информацией, выведенной из ложных корреляций.

Изначальные данные должны обрабатываться, чтобы извлечь из них верные корелляции. Однако именно с этим есть проблемы в нашей цивилизации больших данных.

По словам Талеба, шум антихрупок, поскольку распространяется сам по себе, тогда как настоящая информация хрупка. Как пишет Филипп Зильберцан: «В эпоху мегаданных наши прогнозы становятся ещё более хрупкими. Большие данные = большие неожиданности».

Мы столкнулись с данной проблемой во время пандемии Covid-19. СМИ должны постоянно нам что-то сообщать, особенно в периоды кризиса. Поэтому они производят много шума. Огромное количество информации, которое мы получали во время пандемии, превратило нас в невротиков. Соотношение сигнала к шуму постоянно снижалось. Самым умным решением было выключить телевизор, не заглядывать в газеты и стараться не заходить в интернет.

Исследования показывают, что даже в нормальное время ложная информация в соцсетях циркулирует в 6 раз быстрее, чем верная. В периоды кризиса темпы повышаются.

Вот пример ложной корреляции: верно, что 5 лет назад Билл Гейтс предсказал, что главной угрозой для человечества будет новая пандемия. Верно, что 18 октября 2019 года фонд Билла Гейтса, ВОЗ и Университет Джонса Хопкинса совместно разработали план действий при пандемии вымышленного коронавируса, передавшегося от свиней к человеку на фермах в Бразилии. Верно, что в декабре 2019 года в журнале «Science» вышла статья исследователей, спонсируемых фондом Билла Гейтса, которые писали, что им удалось создать «квантовую точку», которую можно вводить под кожу вместе с вакциной и которая позволят при помощи смартфона проверить, был человек вакцинирован или нет.

Из этих трёх фактов сторонники теорий заговора сделали ложный вывод о том, что за панедмией стоит Билл Гейтс, который хочет вакцинировать весь мир, чтобы присвоить каждому человеку номер, без некоторого невозможно будет покупать, продавать и перемещаться. Одним словом, заключили они, пандемия — это средство установить контроль над человечеством. Как следствие, более 600 тысяч американцев подписали петицию против данного «плана» Билла Гейтса на официальном сайте Белого дома.

Ещё один важный недостаток ИИ — это то, что «оптимизация противоречит усовершенствованию». Как объясняет исследователь Кеннет Стэнли, можно логически объяснить, почему избыток рациональности контрпродуктивен:

«Непредсказуемость не означает, что есть дефицит знаний, который необходимо восполнить. Она являет собой ключевую предпосылку развития знаний».

Гаспар Кёниг пишет:

«Можно сделать вывод, что общество, которое стремится к повышению благосостояния и уменьшению страданий — это мёртвое общество, поскольку оно делает инновации и отклонения невозможными. Это также хрупкое общество, которое может разрушиться при первом же потрясении. Возможно, Китай убедится в этом на собственном горьком опыте».

В этом кроется парадокс Китая.

Как мы видели, китайцы умеют быть антихрупкими и гибкими, что и обеспечивает им ныне преимущество над нами. Тем не менее, китайцы также идут по пути, который рано или поздно приведёт их к потере этого преимущества. Китай имеет один важный структурный недостаток: в стране не приветствуется всё аномальное и нетипичное. А именнно эксцентричные и нестандартно мыслящие люди двигают человечество вперёд огромными скачками.

Разве не показательно, что Китай, 40 лет назад объявивший о начале Большого скачка, сподобился всего на два широко используемых изобретения: электронную сигарету и селфи-палку? Не было создано ничего сопоставимого с портативным плеером от Sony, персональным компьютером или iPhone от Apple. Стремление к стандартизации и однообразию лишь усугубится из-за ИИ. Именно поэтому Гаспар Кёниг утверждает, что несмотря на изначальный прогресс, общество, управляемое ИИ, — это, в долгосрочной перспективе, мёртвое общество.

ЛЮБОВЬ, НАДЕЖДА, ВЫБОР… И КОТ

Первая часть тетралогии «Матрица» вышла в 1999 году. На тот момент мне казалось, что это не более чем экранизация компьютерной игры для подростков. Мой друг, физик Басараб Николеску, первым обратил моё внимание на этот фильм, заявив: «Это же первый фильм XXI века!».

Невозможно сосчитать все статьи, посвящённые философами из разных стран анализу этого фильма, который как нельзя лучше воплощает на экране миф о пещере Платона и размышления о природе реальности. Однако вторая часть, «Матрица: Перезагрузка», зажатая между самой философской первой и самой зрелищной третьей, повествующей о последней битве между людьми и машинами, часто недооценивается. Тем не менее, в ней есть фрагмент, который за несколько минут сообщает нам больше, чем все философские и научные тексты вместе взятые, о важнейшем для нашего будущего вопросе: что на самом деле отличает человека от машины? Что заставляет нас считать, что машина никогда не сможет стать человеком, что она может только подражать нам, но никогда не сможет заменить нас? Что позволяет ответить утвердительно на вопрос о том, есть ли у человека будущее?

Напомним контекст: по итогам войны между людьми и машинами, несмотря на отчаянные попытки людей лишить машины солнечной энергии, покрыв Землю густым слоем облаков, машины обращают людей в рабство. Миллиарды людей «выращиваются» ради электроэнергии, в которой нуждаются машины. Чтобы люди не восстали, для них создан виртуальный мир, Матрица, живущие в котором люди неспособны отличить фантазию от реальности.

Небольшая группа свободных людей, живущих в подземном городе под названием Сион, пытаются пробудить остальных и показать им их истинное положение — так же, как люди, покинувшие пещеру Платона, возвращаются туда, чтобы продемонстрировать остальным ужасную иллюзию, в которой те живут. В конце первой «Матрицы» кажется, что Нео нанёс поражение машинам. Однако во второй части, когда Нео оказывается лицом к лицу с Архитектором (ИИ, создавшим Матрицу), он узнаёт ужасную тайну: он является лишь элементом механизма для порабощения людей. Всё — в том числе восстание людей — было предсказано могущественным ИИ.

В «1984» Джорджа Оруэлла противники режима Большого Брата — одновременно также агенты режима, которые подстрекают склонных к бунтарству людей восставать против власти, чтобы затем заключить их в тюрьму. Так и пророчество, согласно которому «избранный» сможет уничтожить Матрицу, имеет целью помешать человечеству восстать по-настоящему.

Архитектор объясняет выбор, который стоит перед Нео. Дверь по правую сторону приведёт к «перезагрузке» системы: Сион будет уничтожен, но Нео вместе с небольшой группой людей будет поддерживать (ложную) надежду на революцию для следующего поколения. Дверь по левую сторону позволит Нео вернуться в Матрицу, но человечество (как свободные, так и порабощённые люди) будет полностью уничтожено; машины, лишённые главного источника энергии, продолжат существовать, хоть и будут ослаблены.

Но Нео не даёт себя обмануть. «Всё дело в выборе», — говорит он. Архитектор не может повлиять на выбор Нео (что доказывает наличие свободы воли у человека), однако может читать его мысли. Архитектор отмечает, что Нео отличается от своих пяти предшественников, которые приняли правила игры и воспользовались дверью по правую сторону, чтобы спасти человечество от уничтожения.

Нео испытал любовь. Именно любовь Тринити спасла его. Когда его убили агенты Матрицы, поцелуй Тринити вернул его к жизни. Именно любовь толкает его на абсурдный на первый взгляд шаг: вопреки угрозам Архитектора, он выбирает дверь по левую сторону. Архитектор — машина, поэтому не может испытывать эмоций; тем не менее, он не может удержаться от замечания: «Надежда — квинтэссенция человеческих иллюзий. Одновременно источник вашей великой силы и вашей великой слабости».

Этот короткий диалог между олицетворением человечества и олицетворением ИИ наглядно показывает, что отличает человека от машины:

- Любовь. Любовь, которую, по словам Ли Кайфу, машина неспособна испытать. Любовь — это одновременно причина возращения Нео к жизни в первой «Матрице» и причина его, на первый взгляд, иррационального выбора во второй.

- Выбор. Невозможный выбор, как выбор Салли Салленбергера посадить самолёт с отказавшими двигателями на воду вместо того, чтобы пытаться дотянуть до посадочной полосы или хотя бы до автострады. Посмотрев вторую «Матрицу» в первый раз, я определил этот фильм как ответ на вопрос: «Как быть свободным в мире, где свободы не существует?». Работая над этой книгой, я осознал, что вся тетралогия «Матрица» — это средний палец подталкиванию, при помощи которого ИИ и его адепты пытаются повлиять на наши решения и подавить нашу свободу выбора, чтобы принимать решения за нас. Нео восстанавливает эту свободу выбора, в теории невозможную.

- Надежда. В своей книге «С надеждой в сердце» Армандо Вальядарес рассказывает, как не утратил надежду в кубинской тюрьме. Надежда позволила Роберу Пише не сдаться и посадить свой самолёт посреди ночи на Азорских островах, пролетев теоретически невозможные 180 километров.

Стоит отметить, что Нео помогает интересный персонаж — Оракул (Пифия). Она оказывается компьютерной программой, созданной машинами с целью найти подход к странным, непостижимым и иррациональным существам — людям. В итоге Оракул встаёт на сторону людей и поддерживает их в борьбе за свободу. То есть если бы машина могла очеловечиться и понять людей, то приняла бы их сторону.

Третья «Матрица» заканчивается встречей Архитектора и Оракула. Архитектор упрекает Оракула за то, что та ведёт очень опасную игру, препятствуя началу нового цикла разрушения и обновления Сиона, что прежде позволяло держать под контролем восстания людей. Оракул отвечает с улыбкой: «Перемены всегда опасны».

Это отличная иллюстрация идеи Талеба о том, что оптимизация препятствует прогрессу. Мир вечного возвращения, который стремится создать Архитектор, — это мёртвый мир, лишённый новизны. В конце первой «Матрицы» Нео говорит поверженным им машинам: «Вы боитесь перемен», и добавляет, что покажет всем узникам Матрицы «мир, в котором всё возможно».

Да, в краткосрочной перспективе ИИ может очень эффективно управлять нашей жизнью, однако он не только сам неспособен на серьёзные инновации, но и мешает создавать инновации нам, людям.

В мире, которым управляет ИИ, очень мало возможностей для чего-то нового.

Как мы видели, программе глубокого обучения необходимы миллионы фотографий котов, чтобы научиться распознавать любые изображения кота, тогда как человек может достичь того же результата, увидев кота всего 2 или 3 раза. Это ещё один важный момент: хоть машина и подражает определённым человеческим действиям, она достигает результата, действуя совершенно иначе, чем человек.

Ещё одно доказательство тому — шахматы. Как мы видели, ИИ анализирует миллионы ситуаций в секунду, оценивая их и выбирая наиболее выгодные в долгосрочной перспективе. Однако когда у чемпиона мира, одного из величайших шахматистов всех времён, Хосе Рауля Капабланки спросили, сколько вариантов для каждой ситуации он рассматривает, тот с гордостью ответил: «Всего один, но самый лучший!». «Но откуда вы знаете, что он самый лучший?». «Потому что я — чемпион мира».

Великий чемпион интуитивно чувствует, что определённая ситуация выгодна, тогда как машина полагается на расчёты. В некоторых ситуациях машина совершает ошибки, которых даже посредственный игрок не совершил бы, поскольку машина не может просчитать все ходы до конца партии, тогда как игрок, ничего не просчитывая, знает, что тот или иной ход будет проигрышным в долгосрочной перспективе.

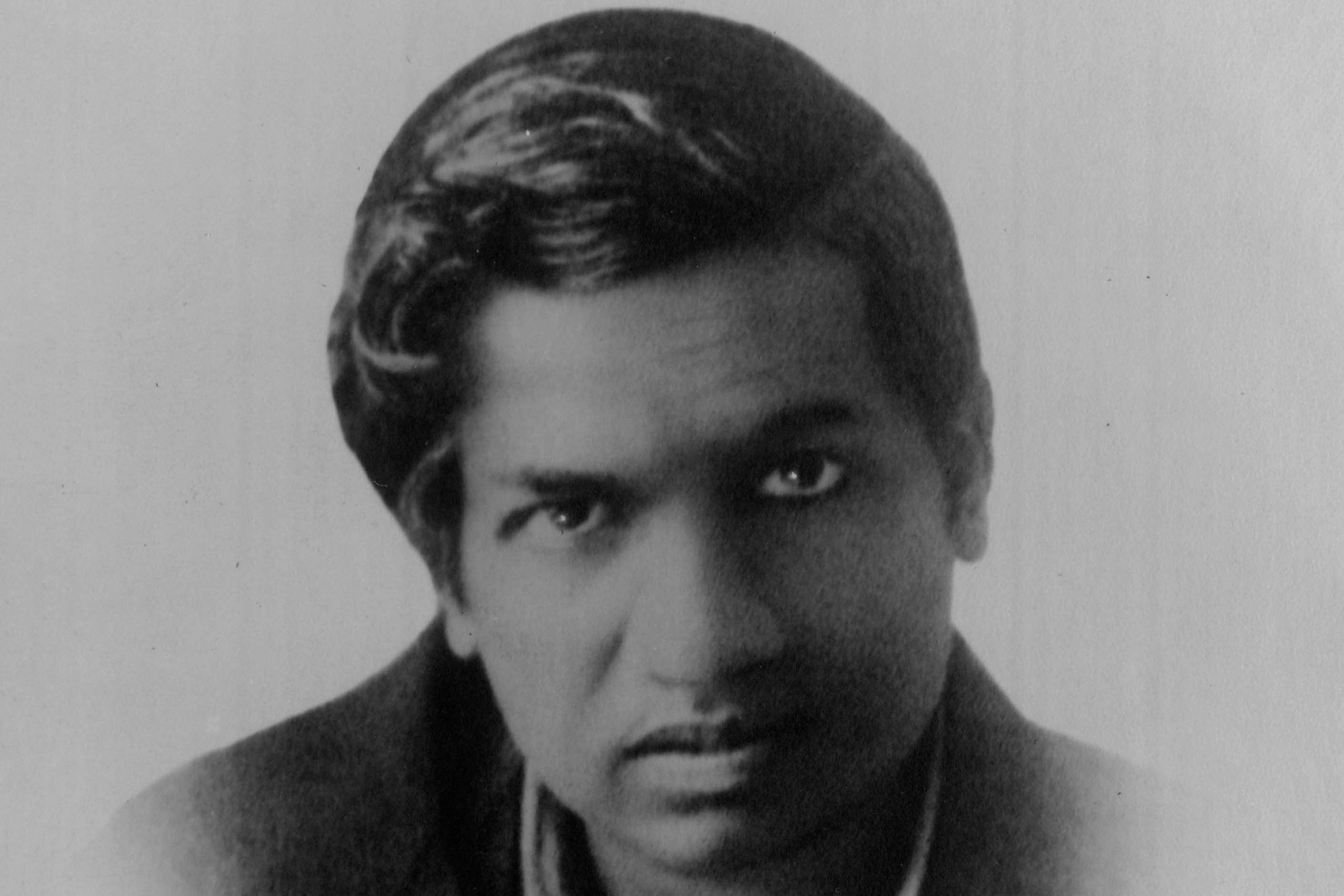

Ещё одним примером служит история Сринивасы Рамануджана. К удивлению кембриджских профессоров, этот молодой индус, не имея специального математического образования, явился в университет с более чем 3 тысячами результатов (без каких-либо доказательств), написанных на маленьких конвертах.

Рамануджан не понимал даже, зачем нужны доказательства. «Зачем мне это доказывать, если это верно?», — говорил он. Ему объясняли, что так устроена наука. К тому же, среди 3 тысяч его результатов было найдено несколько неверных, что бросило тень сомнения и на все остальные. Тем не менее, сегодня, через столетие после его смерти, более 2,9 тысяч признаны верными.

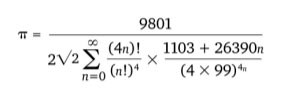

Взять, к примеру, приведённую выше формулу для числа Пи. Рамануджан написал её одним махом, без размышлений и колебаний. Откуда взялись 9801, 1103 и 26390? Как можно интуитивно прийти к подобной формуле? Рамануджан утверждает, что не использовал никакого логического метода, а видел формулы в готовом виде. Он настаивал, что богиня Намагири нашёптывала ему формулы, которые интересовали его лишь по той причине, что выражали божественную мысль.

Физик и математик Роджер Пенроуз, лауреат Нобелевской премии по физике 2020 года, утверждает, что математики имеют доступ к миру платоновских идей. Пенроуз считает, что именно доступ к этому миру предоставляет человеку преимущество перед компьютером и ИИ.

Некоторые специалисты в области ИИ признаются: чем больше они изучают ИИ, тем больше восхищаются человеком.

«ПРОБЕЖКА ДЛЯ УМА» В ПРЕДВКУШЕНИИ МИРА ЭПОХИ ИИ

«Когда мудрец указывает на луну, дурак смотрит на его палец», — гласит народная мудрость. Тогда как весь мир наблюдает за развитием ИИ с восторгом родителей, наблюдающих за первыми шагами своего первенца, назревает необходимость в жизненно важной для будущего человечества миссии: подготовке к миру после наступления эпохи ИИ.

Не может быть и речи о возвращении к миру без компьютеров, интернета и ИИ, так же, как не может быть речи о возвращении к миру без машин, поездов и самолётов. Людям, которые трудились в поле и целый день проводили на ногах (ездить верхом или в дилижансе могли только избранные), показалось бы абсурдом, что мужчины и женщины ХХ—XXI веков заставляют себя заниматься спортом, бегать на месте на беговых дорожках или крутить педали велотренажёра, чтобы не ожиреть по причине своего образа жизни.

Так же, как мы сейчас совершаем пробежки, чтобы минимизировать негативные последствия использования машины, в последующие десятилетия нам придётся практиковать «пробежки для ума», чтобы избежать «умственного ожирения».

Эта пробежка для ума состоит из практик и умственных привычек, первая из которых — не впадать в то, что Нассим Талеб называет «неоманией» (то есть чрезмерное восхищение прогрессом). Талеб объясняет, что нечто, существующее уже тысячу лет, имеет все шансы просуществовать и ещё тысячу. А то, что существует всего 20 лет, имеет все шансы перестать существовать через 20 лет.

Большинство изобретений оказываются неудачными. Об этом часто забывают, так как в памяти остаются те немногие, которые кардинально изменили жизнь людей. Возможно, Талеб немного преувеличивает, но в целом мне кажется, что он прав. Необходимо лишь сделать две оговорки.

Во-первых, нечто, существующее уже тысячу лет — например, книга, — просуществует ещё тысячу, только не в той же — бумажной — форме. Тем не менее, концепция книги по-прежнему будет существовать.

Во-вторых, есть огромная вероятность того, что интернет, существующий всего несколько десятилетий, будет существовать и через несколько десятилетий, хоть и, вероятно, в иной форме (то же самое верно и в отношении смартфона).

Нассим Талеб не говорит ни что всё, существующее уже тысячу лет, просуществует и ещё тысячу, ни что всё, существующее всего 20 лет, перестанет существовать через 20 лет.

Я прогнозирую, что одно недавнее изобретение в будущем исчезнет или, по крайней мере, будет играть намного меньшую роль: соцсети. Само собой, соцсети имеют свою ценность. Например, они позволяют людям, которые в противном случае были бы никем, зарабатывать огромные деньги благодаря статусу инфлюэнсеров и миллионам подписчиков. Но мне осталось жить не более 30 лет, поэтому я не собираюсь тратить время на то, чтобы выкладывать фотографии из отпуска или участвовать в твиттерштормах.

Жизнь слишком коротка для подобных вещей, и после краткого увлечения уорхоловскими «15 минутами славы», интерес к соцсетям пойдёт на спад. Если вы мне не верите, вот аргументы, которые приводит Джарон Ланье, один из пионеров в области виртуальной реальности, в своём бестселлере «10 аргументов в пользу того, чтобы удалить ваши аккаунты из социальных сетей прямо сейчас»:

1. Вы теряете свободу воли.

2. Соцсети созданы так, чтобы вызывать зависимость.

3. Соцсети превращают вас в морального урода.

4. Соцсети способствуют массовой дезинформации.

5. Соцсети лишают ваши слова смысла.

6. Соцсети лишают вас способности испытывать эмпатию.

7. Негативные эмоции — это топливо для соцсетей.

8. Соцсети зарабатывают много денег благодаря данным, которые вы предоставляете им бесплатно.

9. Соцсети оказывают негативное влияние на политическую жизнь.

10. Соцсетям безразлична ваша душа.

Необходимо понимать, что нам не удастся избежать этого мира нового добровольного рабства. Развитие ИИ в самых разных сферах — образовании, управлении городом, медицинской диагностике, беспилотных автомобилях — завораживает нас. И как родители закрывают глаза на проступки своих детей, так и мы будем закрывать глаза на первые аварии беспилотных автомобилей и первые ошибки в управлении умными городами.

Однако когда возникнет некое подобие «коронавируса ИИ» — когда целые города или даже страны окажутся парализованы, когда самолёты начнут сотнями падать с неба, когда миллионы машин застрянут в пробках, когда мы останемся без продовольствия — тогда мы наконец очнёмся.

В сложном мире невозможно предсказать, когда и где произойдёт то или иное событие. Тем не менее, можно с уверенностью утверждать, что определённые события произойдут. Именно так доктор Ян Малкольм из «Парка юрского периода» обосновывает свой прогноз о том, что парк ждёт катастрофа.

Причину уверенности в том, что катастрофа вроде «коронавируса ИИ» произойдёт, объясняет Нассим Талеб: всё хрупкое обречено на разрушение, ведь чем сложнее мир, тем более вероятными становятся кажущиеся маловероятными события; а это также значит, что они происходят намного раньше ожидаемого.

Подчеркнём также, что аналогия с эпидемией оправдана. Томас Пуэйо, который одним из первых предупредил широкую публику и государственных деятелей об опаности запоздалой реакции на пандемию Covid-19, является не биологом, а специалистом по компьютерным вирусам. Есть очевидное сходство между биологическими вирусами и компьютерными; последние могут создать нам ещё больше проблем, чем это сделал коронавирус.

Мы должны начать бороться с подталкиванием в нашей жизни, со скрытым влиянием соцсетей и крупных СМИ на наши мысли и наши решения.

Первый совет, который я даю всем своим слушателям, — это регулярно читать людей, чьи взгляды (политические, экономические и философские) противоположны их собственным. Я и сам ревностно придерживаюсь этого принципа. Речь не столько о том, чтобы менять собственные взгляды, сколько о том, чтобы понимать чужие. А иногда также признавать, что по определённым пунктам кто-то из этих людей может быть прав и чему-то вас научить.

Мы должны бороться за то, чтобы за принятие решений и впредь отвечал человек. Например, за то, чтобы не было автономных умных вооружений, которые бы могли нажимать на кнопку без участия человека. Если у нас будут беспилотные автомобили, они должны иметь руль, и мы должны регулярно отключать автопилот, чтобы практиковаться в вождении. Мы должны выступать против прокладывания дорог, по которым разрешено передвигаться только беспилотным автомобилям. Мы должны настаивать на том, чтобы в каждом самолёте был пилот, который регулярно летает без автопилота.

Отстаивая данную позицию, мы должны быть готовы к тому, что нас будут называть луддитами и реакционерами. Мы знаем, что это не так. Мы вовсе не за то, чтобы жить как амиши. Вынести оскорбления и насмешки нам помогут две мысли. Первая — это неизбежность масштабного кризиса ИИ (ведь каждый, кто понимает теорию хаоса и знаком с трудами Ильи Пригожина, Эдгара Морена и Нассима Талеба, знает, что всё хрупкое однажды рушится). А вторую можно резюмировать фразой, приписываемой Далай-Ламе: «Думайте самостоятельно, ведь иначе это будут делать за вас другие».

ЗАКЛЮЧЕНИЕ

1. КУДА МЫ ИДЁМ?

Мы стоим на пороге поворотного момента. Именно поэтому все те, кто прогнозируют будущее, делают диаметрально противоположные прогнозы. Любопытно сравнить прогнозы колласпологов с одной стороны и корнукопианцев с другой.

Термин «коллапсология» был популяризирован благодаря книге Пабло Сервиня и Рафаэля Стивенса, которые предсказывают неизбежный крах нашей «термо-индустриальной цивилизации», основанной на потреблении невозобновляемых ресурсов. «Те, кто думает, что возможен бесконечный рост в конечном мире, — либо безумцы, либо экономисты», — пишут они. Пандемия Covid-19 подкрепляет данный взгляд: санитарный кризис добавляется к экологическому, климатическому и финансовому, а также предстоящим кризисам, обусловленным исчерпанием природных ресурсов, будь то в сфере промышленности (ценные металлы) или в сфере продовольствия (сельское хозяйство, скотоводство, рыбная ловля). Большинство коллапсологов предсказывают крушение нашей цивилизации самое позднее к 2035 году.

Корнукопианцы верят в «рог изобилия», то есть в неисчерпаемые ресурсы. Самые интересные из них — Аарон Бастани и Питер Диамандис. Дефицит энергии, говорите? По мнению корнукопианцев, энергия скоро будет бесплатной и неограниченной — достаточно лишь взглянуть на развитие солнечной энергии за последние несколько десятилетий. Ещё пару десятилетий в том же темпе, и все наши нужды можно будет обеспечить. Конец работы? Это отличная новость. Ведь любые изделия — не только товары первой необходимости, но и предметы роскоши — будут производиться машинами почти бесплатно. Исчерпание природных ресурсов? Бастани убеждён, что добыча полезных ископаемых на астероидах позволит получить доступ к почти неограниченным запасам ресурсов (один астероид диаметром 200 км, вроде Психеи, содержит металлов на сумму, равную 87 миллиардам мировых ВВП). Богатств, содержащихся в поясе астероидов между Марсом и Юпитером, хватило бы, чтобы выдать по 100 миллиардов долларов каждому обитателю Земли. Вот вам и безусловный базовый доход!

С одной стороны, коллапсологи предсказывают антирост. Авторы отчёта Института Моментум утверждают, что менее чем через 30 лет население Иль-де-Франс сократится с 10 до 2 миллионов человек, количество машин упадёт на 99 процентов, а по дорогам будут передвигаться более 100 тысяч лошадей. С другой, корнукопианцы твердят, что рост лишь ускорится благодаря почти бесплатному труду машин, почти бесплатной и неограниченной энергии, а также неограниченным запасам природных ресурсов из космоса.

Представлители обоих лагерей, тем не менее, сходятся на том, что наш мир будет сложной и нелинейной системой. По мнению одних, это означает, что событие или череда событий «положат» все существующие системы, тогда как по мнению других, нелинейность открывает невиданные возможности.

Одно из главных слабых мест подхода коллапсологов состоит в том, что можно назвать «ошибкой конского навоза».

В 1894 году в лондонской газете «Таймс» вышла статья, в которой утверждалось, что учитывая темпы развития крупных городов вроде Парижа, Нью-Йорка и Лондона, а следовательно и значительное увеличение количества лошадей, необходимых для перевоздки людей и товаров, к 1920 году условия в этих городах станут непригодными для жизни просто потому, что невозможно будет убирать такое количество навоза каждый день. 15 лет спустя в крупных западных городах почти не осталось лошадей. Именно поэтому каждый раз когда я слышу об опасности загрязнения воздуха выхлопными газами в крупных городах, я не могу сдержать улыбку.

Тот факт, что благодаря своей изобретательности и креативности люди прежде всегда находили выход из кризисных ситуаций, само собой, не являетя гарантией того, что так будет и впредь. Однако, как мы знаем, имеющая место ныне великая трансформация открывает уникальные возможности.

Идёт гонка между проблемами и угрозами, о которых говорях коллапсологи, с одной стороны, и реализацией новых и инновационных решений, о которых говорят не только корнукопианцы, но и сторонники «позитивной экологии» (Гюнтер Паули и Уильям Макдонах), с другой. Было бы удивительно, если бы человечество сдалось перед лицом нынешних проблем, какими бы серьёзными они ни были, учитывая, что оно уже сейчас имеет потенциальные решения. Вот почему оптимизм в среднесрочной перспективе (середина XXI века) кажется мне наиболее разумной позицией.

2. КАК МЫ ТУДА ИДЁМ?

У нас есть как минимум одно преимущество: наши подходы, ценности и нормы. Их можно разделить на 5 категорий:

- Нормы и ценности, непосредственно связанные с нелинейностью и сложностью мира.Цивилизация уже изменилась, поэтому на смену вчерашним методам должны прийти подходы, основанные на гибкости, проактивности, антихрупкости и универсальности. В этот период перемен и потрясений, когда эффект бабочки повсюду, предсказать будущее можно только в том случае, если мы сами его творим. Примеры Генри Форда и Томаса Эдисона, Стива Джобса и Илона Маска показывают, что это возможно.

- Реформа образования.Мы должны «научиться учиться». А для этого необходимо пересмотреть четыре столпа современного образования: распределение учеников по классам согласно возрасту, обучение всех по одной и той же программе, выделение одинакового количества времени для каждого на один и тот же материал и оценивание. Нужны новые междисциплинарные подходы и переход от простого изучения планеты к обучению этике, необходимой для совместной жизни в мире, где религии, цивилизации и культуры постоянно сталкиваются друг с другом. Нужно будет разработать новые формы образования, позволяющие каждому ученику заниматься теми дисциплинами, которые интересуют его больше всего (и не только на уровне старшей школы). Нужно будет также учить критически относиться к доступной в интернете информации и развивать в каждом ученике любознательность, чтобы он проявлял интерес и к чужим идеям. Только так удастся избежать негативных последствий fake news, которые распространяются намного быстрее, чем достоверная информация, и подталкивания, при помощи которого на нас воздействуют цифровые гиганты.

- Вера в будущее и доверие членов общества друг к другу и к правителям.Доверие очень долго строится и очень быстро разрушается. Оно может быть основано только на честности и конкретных поступках. Само собой, одной веры в будущее недостаточно, чтобы оно было радужным. Тем не менее, верно и обратное: общество, не имеющее веры в будущее, почти никогда не добивается успеха. Это, вероятно, главная угроза для старушки Европы, и на это в первую очередь должны обратить внимание наши правители.

- Коллективный интеллект.В сложном мире, где невозможно предсказать следующие возможности и следующие проблемы, ни один человек не может самостоятельно управлять организацией или страной. Вот почему развитие коллективного интеллекта должно стать первоочерёдной задачей. Всё больше организаций принимают на вооружение данную модель, а это требует большей вовлечённости всех их членов. Однако этот переход от мира «управления силами» к миру, где власть распределена горизонтально, не должен ограничиваться организациями. То же самое должно происходить и на уровне государств.

- Эмпатия как главная человеческая ценность.Даже такой циник, как Стефан Маллар, утверждающий, что в будущем только необразованные люди будут наёмными работниками, согласен, что в мире, отданном на откуп алгоритмам, эмпатия станет главной ценностью. Само собой, ИИ, изучивший миллионы рентгеновских снимков раковых больных, будет ставить диагнозы лучше любого врача. Но кто хочет услышать о том, что у него рак, от ИИ? Потребители, звонящие с целью получить информацию, уже сейчас сыты по горло роботами, говорящими: «Если вы звоните с этой целью, нажмите 1… если с этой, нажмите 2». В мире завтрашнего дня общение с живыми людьми будет высоко цениться. Наибольшим успехом у клиентов и сотрудников будут пользоваться те компании, которым удастся найти баланс между ИИ и живыми людьми. В мире, где ритм жизни будет ещё более высоким, стремление к хорошей жизни по-прежнему будет актуальным. Одним словом, гуманизм и сопутствующие ему ценности имеют будущее, и это отличная новость.

3. ЗАЧЕМ МЫ ТУДА ИДЁМ?

Грандиозный нарратив и видение необходимы, чтобы объединить людей вокруг общей цели. Современный мир был первой цивилизацией в истории, чей грандиозный нарратив был по большей части «материалистическим». Иметь холодильник, машину, цветной телевизор… само собой, всё это важно для того, кто беден или пережил войну, однако нарратив, основанный на потреблении, недолговечен. Журналист Томас Фридман пишет:

«Мы создали систему роста, основанную на строительстве всё большего количества магазинов, продающих всё большее количество товаров, произодимых всё большим количеством фабрик в Китае, энергия для которых вырабатыватся при помощи угля, вызывающего всё больше изменений климата, при этом позволяя Китаю зарабатывать всё больше денег и покупать всё больше казначейских облигаций США, позволяющих американцам иметь всё больше средств для строительства всё большего количества магазинов, продающих всё большее количество товаров, произодство которых обеспечивает рабочими местами всё больше китайцев… Мы не можем продолжать в том же духе».

Мы всё лучше умеем делать многие вещи, но всё меньше понимаем, зачем мы их делаем. Цивилизация постмодерна не сможет игнорировать вопрос смысла. После высадки человека на Лун. и первых фотографий Земли из космоса были надежды на «планетарное сознание». К сожалению, большинство людей по-прежнему не выработали чувство принадлежности ко всей маленькой голубой планете, а не только к отдельной стране, культуре или религии. А возрождение национализма и фундаментализма нивелировало скромный прогресс, который был достигнут в этом отношении за последние десятилетия.

Лет 20 назад я встретил одного из основателей Дня Земли и поставил ему следующий вопрос: «Через миллиард лет, а может и раньше, на Земле не останется ни одного живого существа, ни одной травинки и ни одной бактерии, поскольку температура поднимется до 400 градусов. Какая разница, исчезнет ли жизнь на планете через несколько десятилетий или через несколько миллиардов лет, если ей суждено исчезнуть?». К моему удивлению, он не задумывался над данным вопросом и, не зная, что ответить, переадресовал вопрос мне. Я ответил, что у меня ответ есть, но он основан на вере.

Я верю, что мы живём в мире, в котором гусеницы могут превращаться в бабочек, и чем дольше будет существовать этот мир, тем больше времени будет у гусениц (то есть у нас, людей), чтобы превратиться в бабочек, то есть устремиться навстречу иным мирам. Именно поэтому Землю необходимо беречь.

Возможен и другой ответ, атеистический: если жизнь возникла случайно, необходимо делать всё возможное, чтобы она просуществовала как можно дольше. Разумная жизнь имеет ценность в этом безразличном мире, в котором мы одни наделены сознанием.

Третий ответ, более подходящий для мира завтрашнего дня, может звучать так: поскольку мы умеем создавать виртуальные миры, которые всё больше напоминают мир реальный, кто может гарантировать, что мир, в котором мы живём, не является виртуальным миром, созданным цивилизацией из другого измерения? Сценарий а-ля «Матрица» всерьёз обсуждается известными учёными вроде физика Брайана Рэндолфа Грина и предпринимателей из Кремниевой долины вроде Илона Маска. В таком мире мы будем чем-то вроде «серьёзной компьютерной игры». Стоит отметить, что данная идея имеет много общего с «традиционным» сценарием, согласно которому наше настоящее Я — это наша душа, тогда как наше физическое тело — это аватар, как в Second Life и других многопользовательских играх; а доступ к тому, что религии называют раем, зависит от количества «очков», набранных за время пребывания в этом мире — прямо как в компьютерной игре.

Все эти три сценария подразумевают одни и те же действия: люди должны не переставать воображать, создавать, строить и развиваться, используя все доступные возможности не только на Земле, но и за её пределами, чтобы помочь гусенице превратиться в бабочку.

Как сказал Поль Валери: «Мы, цивилизации, теперь знаем, что мы смертны». Однажды наша термо-индустриальная цивилизация подойдёт к концу. Но мы должны делать всё для того, чтобы это произошло как можно позже, используя как собственные способности, так и возможности ИИ.

Однако этого мало. Андре Мальро говорил: «Мало какая цивилизация не основана на духовных началах». Он также говорил: «Главной задачей следующего века, перед лицом величайшей угрозы в истории человечества, будет восстановить в правах богов». Из уст этого известного агностика и ярого противника монотеизма (отсюда использование слова «боги» во множественном числе) это важное заявление. Вопрос смысла жизни, который мы всячески подавляли, встанет вновь.

Мы можем временно удовлетворить потребность в смысле при помощи трёх грандиозных нарративов, упомянутых выше, но в долгосрочной перспективе нужно идти дальше. Нам придётся найти общую для всех raison de vivre, если мы хотим, чтобы наша цивилизация просуществовала ещё много столетий, а не всего несколько десятилетий.

Нам придётся выбирать между царством смысла и тьмой бессмыслия.

©Jean Staune

Это сокращённая версия книги. Оригинал можно почитать тут.